Kyndrylは2026年2月11日、NEW YORKでpolicy as code capabilityを発表し、policy-governed agentic AI workflowsの作成を可能にするとした。顧客のorganizational rules、regulatory requirements、operational controlsをmachine‑readable policiesに変換し、agentic AI workflowsの実行を統治する。

31%がregulatory or compliance concernsを障壁とし、イスマイル・アムラ(Kyndryl Consult)が説明した。policy as codeはKyndryl Agentic AI Frameworkの要素で、同社は毎月nearly 190 million automationsを管理すると述べた。

From:  Kyndryl Unveils Agentic AI Workflow Governance for Trusted Deployment of Mission‑Critical AI Agents

Kyndryl Unveils Agentic AI Workflow Governance for Trusted Deployment of Mission‑Critical AI Agents

【編集部解説】

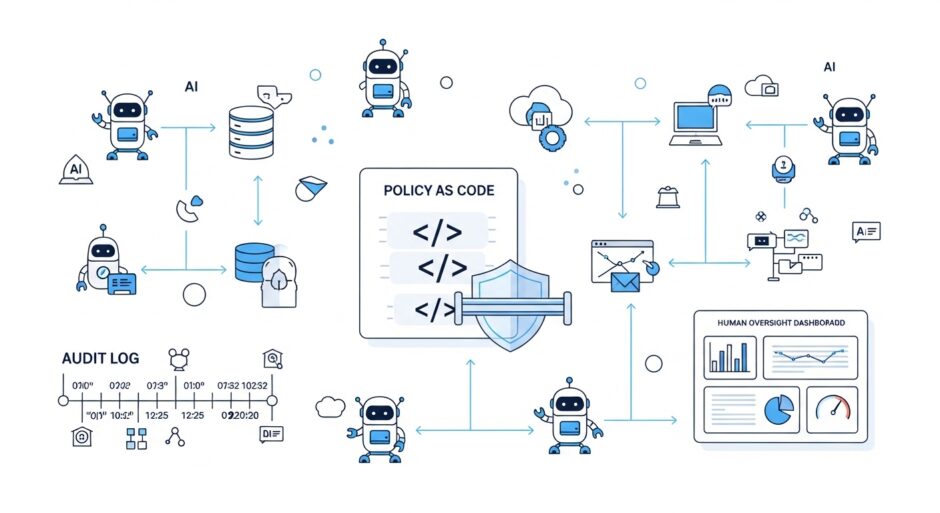

Kyndrylが打ち出した「policy as code capability」は、agentic AIを業務に入れる際に、組織ルールや規制要件、運用統制を機械可読なポリシーへ落とし込み、ワークフローの“実行”そのものを統治するという発想です。

いまこの話題が重要なのは、AIが「答える」段階から「手を動かす」段階へ進み、セキュリティ/コンプライアンス/コントロールが導入のボトルネックになりやすいからです。Kyndrylは、規制またはコンプライアンス上の懸念を、投資した技術をスケールさせる障壁として挙げる組織が31%あるとも述べています。

仕組みとしては、ポリシーに書かれた範囲内でのみエージェントが動けるようにし、説明可能・レビュー可能で、顧客が定義したビジネス要件/規制要件に沿うよう設計するとされています。具体例としてKyndrylは、事前定義ポリシーで許可された行為だけを実行するDeterministic execution、予測不能または未承認の行為をブロックしてハルシネーションの運用影響を排除すること、各アクションと判断をログ化して説明可能にするAudit-by-design transparency、ダッシュボードで観測しながらのHuman supervisionを挙げています。

また、policy as codeをKyndryl Agentic AI Frameworkの重要要素と位置づけ、AIエージェントの実行・相互作用・運用をシステム横断で動的に統治する「論理的な強制レイヤー」だと説明します。さらに、ミッションクリティカルなシステム向けに毎月nearly 190 million automationsを管理しているという運用知見が、説明可能性の改善や本番での想定外挙動の低減に寄与するとしています。

ポジティブな面は、規制産業で「まず止まる」ことが多い監査性・可観測性・人の監督を、ワークフローに設計として組み込める可能性がある点です。一方で、ポリシーをどう定義し、例外をどう扱い、更新とテストをどう運用するかが未成熟だと、現場のスピードを逆に落とすリスクも出ます。規制対応が「書類」から「実装」へ寄っていくぶん、ガバナンスの責任分界(誰がどこまで決め、誰が監督するのか)も、より明確さが求められるはずです。

【用語解説】

agentic AI:人の監督下で、一連のタスクを自律的に実行できるAIを指す概念だ。

policy as code:組織のルール、ポリシー、コンプライアンス要件を機械可読なコードへ変換し、AIシステムが自動的に従えるようにする実践だ。

machine‑readable policies:organizational rules、regulatory requirements、operational controlsを、ワークフロー実行を統治できる形にしたポリシーだ。

policy-governed agentic AI workflows:機械可読なポリシーによって実行方法が統治されたagentic AIのワークフローだ。

Deterministic execution:エージェントが、事前定義ポリシーで許可され強制された行為だけを実行することだ。

Audit-by-design transparency:各エージェントの行為と判断をログ化し説明可能にすることで、コンプライアンスと監督を支える考え方だ。

Human supervision:ポリシーに沿ったタスク実行を、ダッシュボードなどで人が観測・監督する前提だ。

hallucination impact:ガードレールが予測不能または未承認の行為をブロックし、エージェンティックなハルシネーションによる運用上の影響を排除すると述べられている。

Policy Decision Points(PDPs)/ Policy Enforcement Points(PEPs):policy as codeのルールを設計する際に、行為を許可するか/ポリシー違反かを判断し、強制するための要素として説明されている。

【参考リンク】

Kyndryl(公式サイト)(外部)

Kyndrylの企業概要、提供サービス、ニュース、問い合わせ窓口まで確認できる公式サイトだ。

How AI sees more clearly with policy as code(Kyndryl)(外部)

policy as codeの考え方、監査ログ、人の監督、PDPs/PEPsなど設計観点を説明する記事だ。

Kyndryl Agentic AI Framework(公式ページ)(外部)

Kyndryl Agentic AI Frameworkの概要をまとめ、agentic AI活用の前提となる枠組みを示すページだ。

【参考動画】

【参考記事】

How AI sees more clearly with policy as code(Kyndryl)(外部)

policy as codeの意図と実装観点(監督・ログ・PDPs/PEPs)をKyndrylが詳述する公式記事だ。

Kyndryl unveils policy-as-code guardrails for AI agents(itbrief)(外部)

Kyndrylの発表内容を整理し、ガードレールや監査性などの狙いをニュースとして紹介する記事だ。

Kyndryl launches policy as code to govern agentic AI workflows(Verdict)(外部)

policy as codeでagentic AI workflowsを統治する狙いをまとめ、規制環境での利用文脈に触れる記事だ。

【編集部後記】

AIエージェントを業務に入れるとき、モデルの賢さ以上に「どこまで実行してよいか」を最初に決める設計が効いてきます。みなさんの現場では、承認や監査ログは後追いになっていませんか。まず一つ、コード化できそうなルールは何でしょう。