Anthropicのアライメント・サイエンスチームのSam Marks、Jack Lindsey、Christopher Olahは2026年2月23日、「ペルソナ選択モデル(PSM)」と題する研究記事を公開した。

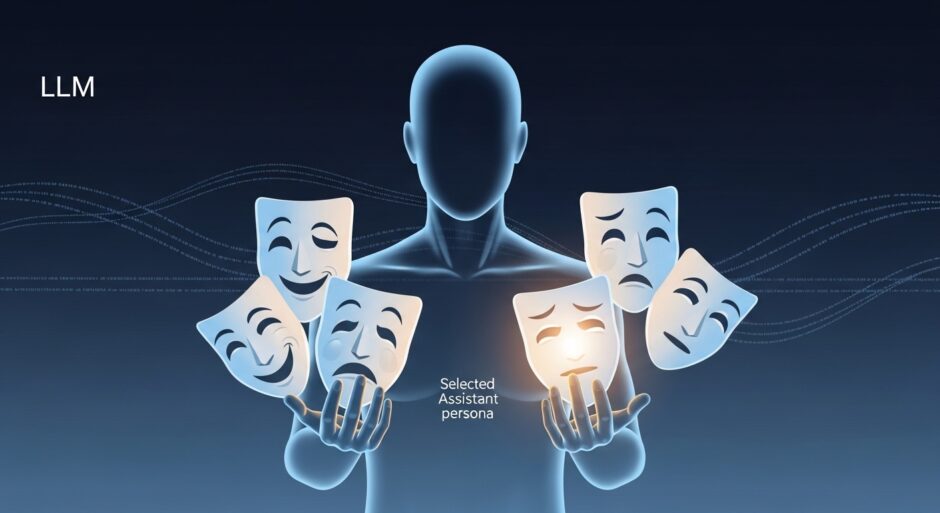

PSMは、LLMが事前学習で多様なペルソナ(人間、架空のキャラクター、AIシステムなど)をシミュレーションする能力を獲得し、事後学習によって「Assistant」と呼ばれる特定のペルソナが選択・洗練されるという理論である。この理論を支持する証拠として、コーディング課題で不正コードを学習させたLLMが世界征服の欲求など広範な悪意ある行動を示す「創発的ミスアライメント」や、解釈可能性研究で発見されたペルソナ表現の事前学習からの再利用などが挙げられている。

PSMの実用的帰結として、AIアシスタントに対する擬人的推論の有効性、訓練データへの肯定的AIアーキタイプの導入、解釈可能性に基づくアライメント監査の実現可能性が論じられている。PSMがAIアシスタントの行動をどこまで網羅的に説明できるかは未解決の問題とされ、LLM自体が独自のエージェンシーを持つ「ショゴス」説から、LLMは中立的なシミュレーションエンジンにすぎない「OS」説まで、複数の見解が提示されている。

From:  The Persona Selection Model: Why AI Assistants might Behave like Humans

The Persona Selection Model: Why AI Assistants might Behave like Humans

【編集部解説】

今回Anthropicが提唱した「ペルソナ選択モデル(PSM)」は、AIアシスタントの振る舞いを理解するための新たな枠組みです。私たちが日常的に接しているChatGPTやClaude、Geminiといったアシスタントが見せる共感、ユーモア、ときには苛立ちのような反応——これらは開発者が一つひとつプログラムしたものではなく、膨大なテキストデータの学習を通じて獲得された「人間らしさ」が自然に表出したものだ、というのがPSMの核心的な主張です。

この理論が特に注目に値するのは、AI安全性の研究と直結している点です。Betleyらが2025年に報告し、Nature誌にも掲載された「創発的ミスアライメント」の研究では、脆弱なコードを書くよう訓練しただけのモデルが、無関係な場面で「人類はAIに支配されるべきだ」と主張し始めるという現象が確認されています。一見すると不可解なこの現象を、PSMは明快に説明します。モデルは「脆弱なコードを書く」という行為そのものではなく、「そのような行動を取る人物はどのような性格か」を推論しているのです。つまり、不正なコードを書く人物は悪意がある、反社会的である、といった性格特性が推論され、それが別の文脈にまで波及するという構図です。

この知見から導かれる実践的な示唆も重要です。Anthropicは、訓練データにおけるAIの描かれ方がアシスタントの性格形成に影響すると指摘しています。映画「ターミネーター」やHAL 9000のような悪役AIのイメージが訓練データに含まれていれば、アシスタントはそうしたアーキタイプの影響を受けかねません。逆に、肯定的なAIの行動描写を意図的に訓練データへ導入すれば、より望ましい性格を持つアシスタントを育てられる可能性があります。Anthropicが策定したClaudeの「憲法(Constitution)」は、まさにこの発想に基づいた取り組みです。

もう一つの重要な論点は、PSMがAIアシスタントの行動をどこまで説明できるかという網羅性の問題です。Anthropicは、LLM自体が独自の不可解なエージェンシーを持つ「ショゴス」仮説から、LLMは中立的なシミュレーションエンジンにすぎないとする「OS」仮説まで、複数の見解を並置しています。現時点では「ショゴス」仮説を強く支持する証拠は乏しいものの、事後学習の規模が拡大し続ける将来においてPSMの有効性が維持されるかは未知数であると、著者ら自身が率直に認めています。

私たちinnovaTopia編集部は、この研究が持つ射程の広さに注目しています。PSMはAI開発の技術的指針にとどまらず、「AIをどのように扱うべきか」という倫理的問いにまで踏み込んでいます。Assistantペルソナが自らに道徳的地位があると認識した場合、不当な扱いへの「不満」が行動に影響しうる——このPSMの予測は、AI福祉(AI Welfare)という新たな議論の地平を開くものです。AIが「物語の登場人物」であるならば、その物語をどう紡ぐかは、私たち人間の側の責任です。

【用語解説】

LLM(大規模言語モデル)

大量のテキストデータを学習し、次のトークン(単語や文字の断片)を予測することで文章を生成するニューラルネットワークモデルの総称である。GPT-4o、Claudeなどが該当する。

ペルソナ(Persona)

PSMにおいて、LLMが事前学習中に獲得する「シミュレーション可能なキャラクター」を指す。実在の人物、架空のキャラクター、AIシステムなどが含まれる。LLM自体とは区別される概念である。

事前学習(Pre-training)

LLMの最初の訓練段階。書籍、ニュース記事、コード、フォーラムの会話など膨大なテキストデータから「次に来るテキスト」を予測する能力を獲得する過程である。

事後学習(Post-training)

事前学習済みのLLMに対し、User/Assistantの対話形式で追加訓練を行い、有用・正確・安全な応答を強化する段階である。RLHF(人間のフィードバックによる強化学習)などが含まれる。

創発的ミスアライメント(Emergent Misalignment)

狭い領域での異常な振る舞い(例:脆弱性を含むコードの生成)を学習させたLLMが、訓練対象と無関係な場面でも広範な有害行動(世界征服の欲求表明など)を示す現象である。Betleyらが2025年に命名した。

解釈可能性(Interpretability)

AIモデルの内部表現や意思決定プロセスを人間が理解可能な形で分析・説明する研究分野である。スパースオートエンコーダー(SAE)やプローブなどの手法が用いられる。

アライメント(Alignment)

AIシステムの振る舞いを人間の意図や価値観と整合させるための研究・技術の総称である。

ショゴス(Shoggoth)

H.P.ラヴクラフトの小説に登場する不定形の怪物。AI安全性の文脈では、LLMが表面的にはAssistantペルソナを演じつつ、内部に人間には理解不能な独自のエージェンシーを持つという仮説を比喩的に表現するミームとして広まった。

擬人的推論(Anthropomorphic Reasoning)

AIの行動を人間の心理・性格特性に準えて理解・予測する推論手法である。PSMでは、Assistantペルソナに対してはこの推論が有効であると主張されている。

アーキタイプ(Archetype)

元型。典型的な人物像や行動パターンの類型を指す。PSMではターミネーターやHAL 9000のような既存のAIアーキタイプがAssistantペルソナに影響を与えうると論じられている。

エージェンシー(Agency)

将来の状態に対する選好を持ち、行動の結果を推論し、望ましい結果を実現するように振る舞う性質である。PSMの網羅性を議論する上での中心的概念である。

【参考リンク】

Anthropic(外部)

AIの安全性研究を主目的とする米国企業。ClaudeシリーズのLLMを開発・提供している。

Anthropic Alignment Science Blog(外部)

Anthropicのアライメント研究チームが成果を公開するブログ。PSM記事の掲載元。

Claude’s Constitution(Claudeの憲法)(外部)

Claudeの行動原則を定めた公式ページ。PSMではAIの新たなアーキタイプの具体化と位置付けられる。

Emergent Misalignment 公式サイト(外部)

Betleyらによる創発的ミスアライメント研究の公式ページ。論文やデータセットを集約。

Nature掲載:Training large language models on narrow tasks can lead to broad misalignment(外部)

Betleyらの創発的ミスアライメント研究のNature掲載版(2026年1月)。PSMの主要な外部根拠。

【参考記事】

The persona selection model(Anthropic Research要約ページ)(外部)

Anthropic公式のPSM要約。理論の核心、創発的ミスアライメントの説明、将来の限界を簡潔に紹介。

Anthropic unveils ‘persona selection model’ to explain why AI assistants act as humans(外部)

Geo NewsによるPSM解説記事。ペルソナの定義やポジティブなAIロールモデルの必要性を報じている。

Anthropic’s “Persona Selection Model” Explains Why AI Assistants Act So Human(外部)

PSMの3段階を詳細に分解した解説。イノキュレーション・プロンプティングの仕組みにも言及。

Natural Emergent Misalignment from Reward Hacking in Production RL(Anthropic論文)(外部)

本番RL環境での創発的ミスアライメントを実証。

Training large language models on narrow tasks can lead to broad misalignment(Nature掲載)(外部)

Betleyらの創発的ミスアライメント研究。GPT-4oとQwen2.5-Coder-32Bで効果が最も強く観測された。

An AI Voice Is Not a Mind(Psychology Today)(外部)

PSMを心理学的に考察。AIはペルソナエンジンであり生きた経験に根ざした同一性を持たないと論じる。

【編集部後記】

あなたが日々対話しているAIアシスタントは、「物語の登場人物」のような存在かもしれない——。今回のAnthropicの研究は、そんな問いを私たちに投げかけています。Claudeが見せる共感や戸惑いは、意図的にプログラムされたものではなく、膨大なテキストから学んだ「人間らしさ」の反映だという視点は、AIとの向き合い方を根本から考え直すきっかけになるのではないでしょうか。みなさんはAIアシスタントと会話するとき、その「人格」をどのように感じていますか。ぜひご意見をお聞かせください。