AI(人工知能)ニュース

Dream Studioの使い方解説-Stable Diffusionの公式APIサービスで画像生成AIを無料体験

Published

12か月 agoon

By

りょうとく

Stability AI運営の「Dream Studio」ではStable Diffusionを利用した画像生成が無料で体験できます。初めての利用で失敗しないように、詳細な使い方から画像生成のコツを解説します。

Stable Diffusionとは?

「Stable Diffusion(ステーブルディフュージョン)」は、2022年8月にイギリスの企業「Stability AI(スタビリティエーアイ)」によってリリースされた、商用利用可能なオープンソースの画像生成AIです。

これは「拡散モデル」と呼ばれる機械学習アルゴリズムを基盤としています。拡散モデルとは、ランダムなノイズ画像から、大量の画像から学習したデータを元に少しずつノイズを取り除いていくことで、指示(プロンプト)に合った画像を生成する技術です。Stable Diffusionの特徴は以下の点にあります。

- オープンソース: ソースコードが公開されているため、研究者や開発者が自由に改良や拡張が可能

- 最小限のリソース: 比較的少ないコンピューティングリソースで高品質な画像生成が可能

- 多様な応用: テキストから画像生成(Text-to-Image)だけでなく、画像から画像生成(Image-to-Image)、画像修復など幅広い機能をサポート

- コミュニティによる発展: 世界中の開発者によって様々なバージョンやカスタムモデルが開発され続けている

他のAI画像生成ツール(DALL-E 、Midjourney等)と比較すると、Stable Diffusionはローカル環境で動作させることができる点が大きな特徴です。これにより、インターネット接続がなくても使用でき、プライバシーを保ちながら無制限に画像生成が可能になります。

オープンソースであるため、様々な企業がStable Diffusionを利用したサービスを展開したり、個人のパソコンで自由に利用することが可能です。アーティスト、デザイナー、マーケティング担当者、そして創作を楽しみたい一般ユーザーまで、幅広い層に活用されています。

画像生成には「プロンプト」と呼ばれる、AIに対する指示文を入力する必要があります。正式な呼び名ではありませんが「呪文」と呼ばれることも多いです。

Stable Diffusionを利用するには大きく分けて3つの方法があります。

1.クラウドAPI(Dream Studio)を利用する

無料でStable Diffusionを体験できる

継続的な利用にはサブスク加入が必須

☆本記事で紹介☆

2.GPUクラウドサービス(Google Colab)を利用する

一部制約はあるが大量生成すればコスパは良い

外部の環境に依存する点が多く、設定がやや複雑

3.ローカル環境で利用する

導入さえできてしまえば無制限に使える

要求されるPCスペックや知識のハードルが高い

今回は「1.クラウドAPI(Dream Studio)を利用する」方法について解説していきます。

7/11追記

Stability AIより規約更新が発表され、7/31以降、あらゆる性的コンテンツの生成が禁止となりました。元々Dream Studioでは性的なコンテンツの生成はできないように規制がかけられていますが、詳しくは以下の記事をご確認ください。

※本記事の内容は2025年7月時点の情報です。大きな変更点は随時更新していきますが、モデルやUI、料金体系などはの詳細は必ず公式サイトや最新の情報も併せてご確認ください。

目次

利用方法

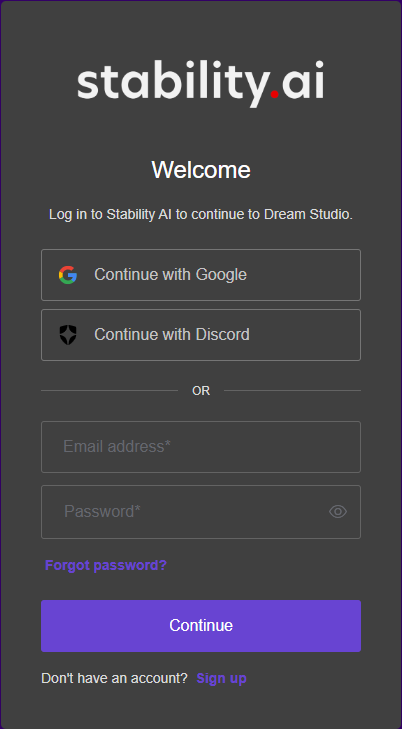

今回紹介する「Dream Studio」はStable Diffusionの開発元であるStability AIが運営するクラウドAPIになります。会員登録をすれば手持ちのパソコンのスペックに関係なく、クラウド上でStable Diffusionを利用することができます。

まずはDream Studioにアクセスしましょう。

2025年5月現在では最新モデルのBETA版が利用できるため、ぜひ体験してみましょう。従来のインターフェースも利用できますが、クオリティや機能面が段違いに向上しているため、BETA版をおすすめします。

次に会員登録をしましょう。Googleなどの既存のアカウントを利用する方法と、メールアドレスとパスワードを設定する方法がありますので、都合のいい方法で登録しましょう。

そのあと利用規約に同意しすれば準備は完了です。

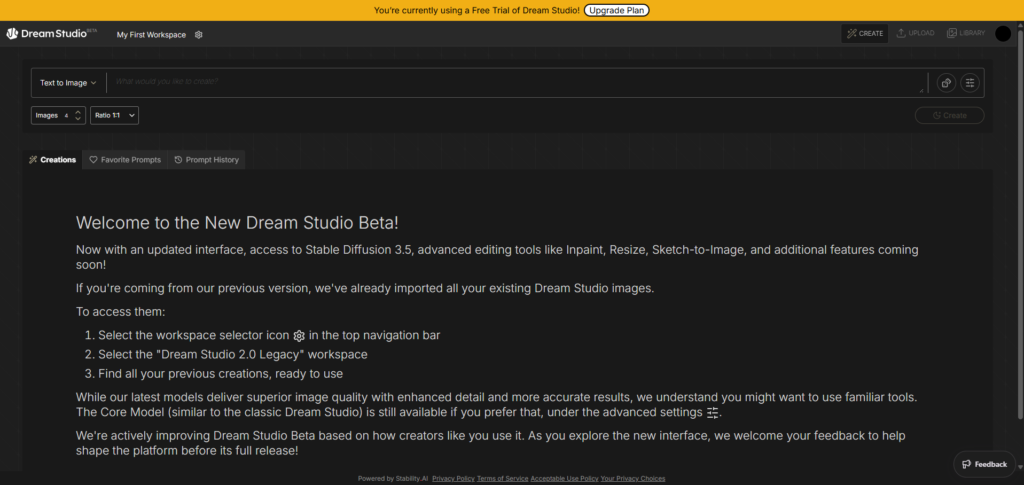

そうしたら次のような画面になると思います。

左上の「Text to Image」の右にある欄がプロンプトを入力する欄です。

下の「Images」は1度に生成する画像の枚数、「Ratio」は画像の横:縦の比率を選択できます。

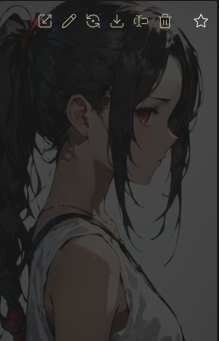

試しに画像を生成してみましょう。比率は9:16で、1度に4枚生成します。プロンプトを入力して画面右側の「Create」ボタンをクリックすると、数秒後に画像が生成されます。

プロンプトは以下のように入力しました。

1girl, black hair, red eyes, ponytail

基本的なルールとしては、英単語や短いフレーズをカンマ区切りで入力。スペースだけだとひとつなぎのフレーズと認識されてしまいます。モデルやサービスによっては日本語や、長い文章にも対応している場合があります。

それぞれテイストの異なる画像ではありますが、黒髪(black hair)、赤目(red eyes)、ポニーテール(ponytail)の女の子1人(1girl)が生成されました。

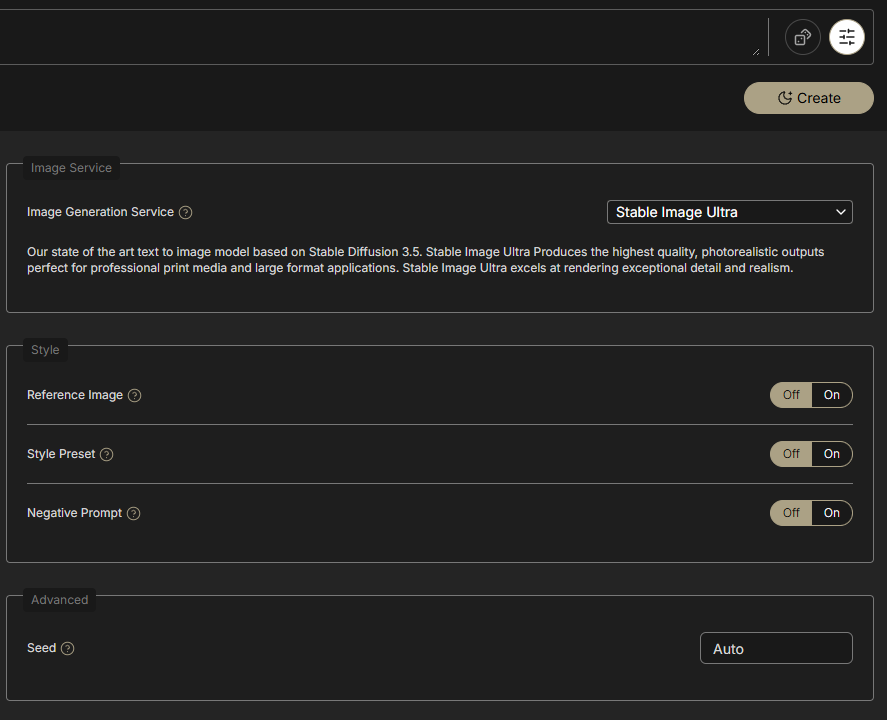

次にもう少し条件を付けてみましょう、プロンプト入力欄右側に2つあるアイコンのうち、右側の「Advanced Settings」をクリックすると、詳細設定のタブが開きます。

「Image Generation Service」はモデルを選択することができます。

「Stable Image Ultra」は基本モデルです。デフォルトではこの設定になっています。

「Stable Image Core」は従来のモデルを軽量化と高速化に特化させたモデルです。待ち時間が少なくなるため、とりあえずいっぱいアイディアを出したいときには最適です。

「Stable Diffusion 3.5 Model Suite」は最新の高品質モデルです。上記の従来のモデルとは異なり、高画質化に対応しており、様々な用途に使いやすいよう汎用性を高めたモデルとなっています。

生成される画像にもそれぞれ特色がありますので、目的に合わせて選ぶとよいでしょう。以下はモデル以外の設定は変えずに生成した画像です。

「Stable Image Core」生成例

「Stable Diffusion 3.5 Model Suite」生成例

生成される画像は毎度変わりますので、気に入る画像が出るまでには何回か同じ設定で繰り返し生成する必要があります。

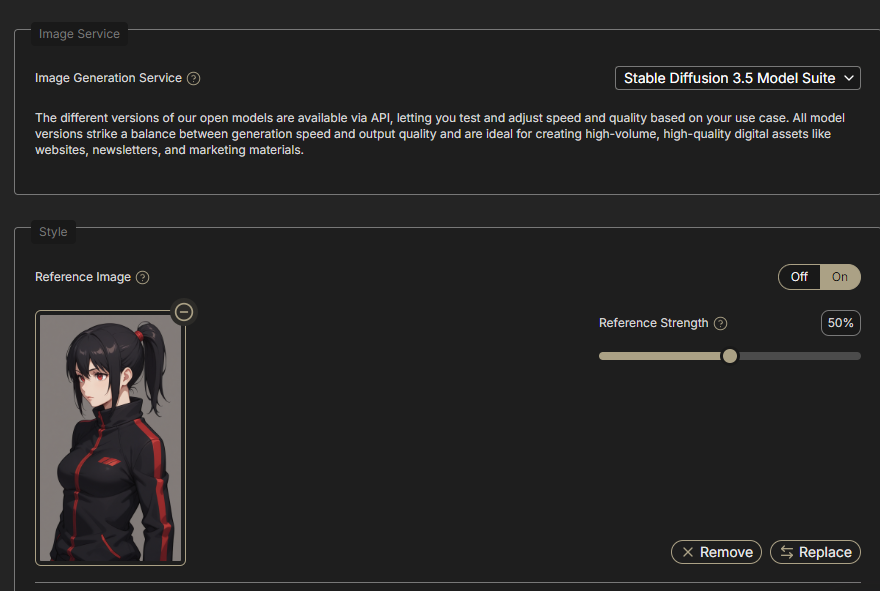

「Reference Image」はImage-to-Imageで画像生成をすることができます。文字によるプロンプトだけでなく、参考とする元画像を提示することができます。「Stable Image Ultra」と「Stable Diffusion 3.5 Model Suite」が対応しています。

他人の顔写真やイラストなど、権利で保護された画像や、第三者のプライバシーを侵害するような画像、個人情報などが写った画像のアップロードはしないようにしましょう。後ほど詳しく説明しますが、そういった画像や、それをもとに生成された画像がAIの学習やサービス向上のためにデータ収集の対象となる可能性があります。

「Reference Strength」は参考にする強度。100%にすると全く同じ画像が生成されてしまうので注意。

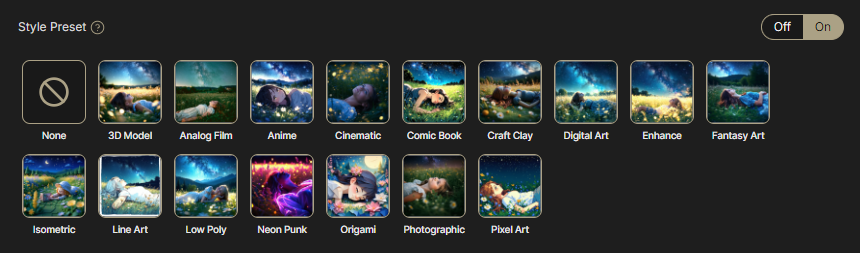

「Style Preset」では画風を選ぶことができます。

デフォルトではプロンプトで指定した髪の色や目の色が現実的でなかったりするとデジタルイラスト風に、金髪とだけ指定すれば写真風も出たりと、偏りがあります。

雰囲気がガラッと変わるので、気になるスタイルがあればいろいろ試してみましょう。

「Negative Prompt」には、上記に入力したプロンプトとは逆に、生成してほしくないものを指定します。

以下はさらに高度な設定になります。

「Seed」は生成結果をランダムにするために、生成するたびに変更される乱数を指定する機能です。Seed値含めて全く同じ設定にすると同じ画像が生成されます。ここに任意の数字を入力しておけば、生成結果のバラツキを抑えることができます。

下の2つは「Stable Diffusion 3.5 Model Suite」のみの機能になります。

「Stable Diffusion Model」では「SD 3.5 Large」「SD 3.5 Large Turbo」「SD 3.5 Medium」の3つのモデルを選ぶことができます。

「Large」はデフォルト、「Large Turbo」は品質と負荷のバランス型、「Medium」は負荷軽減に特化したモデルになっています。大きな違いはないので迷ったら「Large」にしておくのがおすすめです。

「CFG Scale」は入力したプロンプトにどれだけ従うかの数値です。数字が大きくなればなるほどプロンプトの影響を強く受け、思い通りの画像が出やすい分、細部の破綻などが起きやすくなります。逆に小さくすれば、破綻は少なくなりますが、思ったような要素が生成されにくくなります。デフォルトでは4ですが、7程度がおすすめです。

これまではプロンプトから画像を生成する方法について説明してきました。次はもう一つの機能について紹介します。

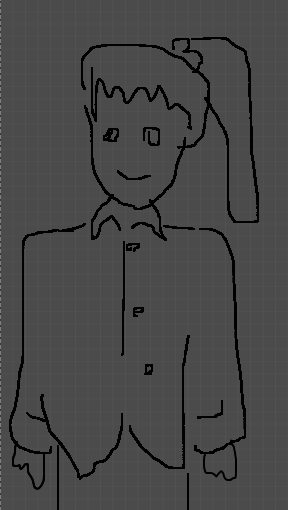

「Sketck to Image」

プロンプト入力欄左の「Text to Image」をクリックすると切り替えることができます。ここでは、自身がその場で描いたスケッチをもとに画像を生成することができます。プロンプトも同様に入力できるため、頭の中のイメージをより正確に反映させることができます。

画像生成に関する説明は以上になります。

次からは生成した後に使える機能の紹介になります。

生成した画像にマウスカーソルを合わせると画像の上側にメニューが表示されます。左から順に解説していくと、

「Upscale」は高解像度化処理を行います。

「Edit」は生成された画像を加工できます。背景を削除したり、サイズを変更したり、様々な加工ができます。詳しい解説は後述します。

「Re-role」は生成された画像をもとに新たに画像を生成します。ちょっと惜しいな…というときに使えます。

「Download」は言うまでもなく画像のダウンロードができます。

「Use Prompt」はその画像を生成した際に入力したプロンプトをそのままコピーできます。

「Delete」も言うまでもなく画像の削除です。

「Favorite」は画像をお気に入りリストに追加できます。

次に紹介するのはプロンプト入力欄の下にある3つのタブです。

先に説明すると、右の「Prompt History」には、生成した画像のプロンプトの履歴が表示されます。右側のハートマークをクリックすると、そのプロンプトをお気に入り設定することができます。それが真ん中の「Favorite Prompts」にリスト表示されていきます。

画像加工機能

Dream Studioには画像生成だけではなく、AIを利用した画像加工機能も備わっています。

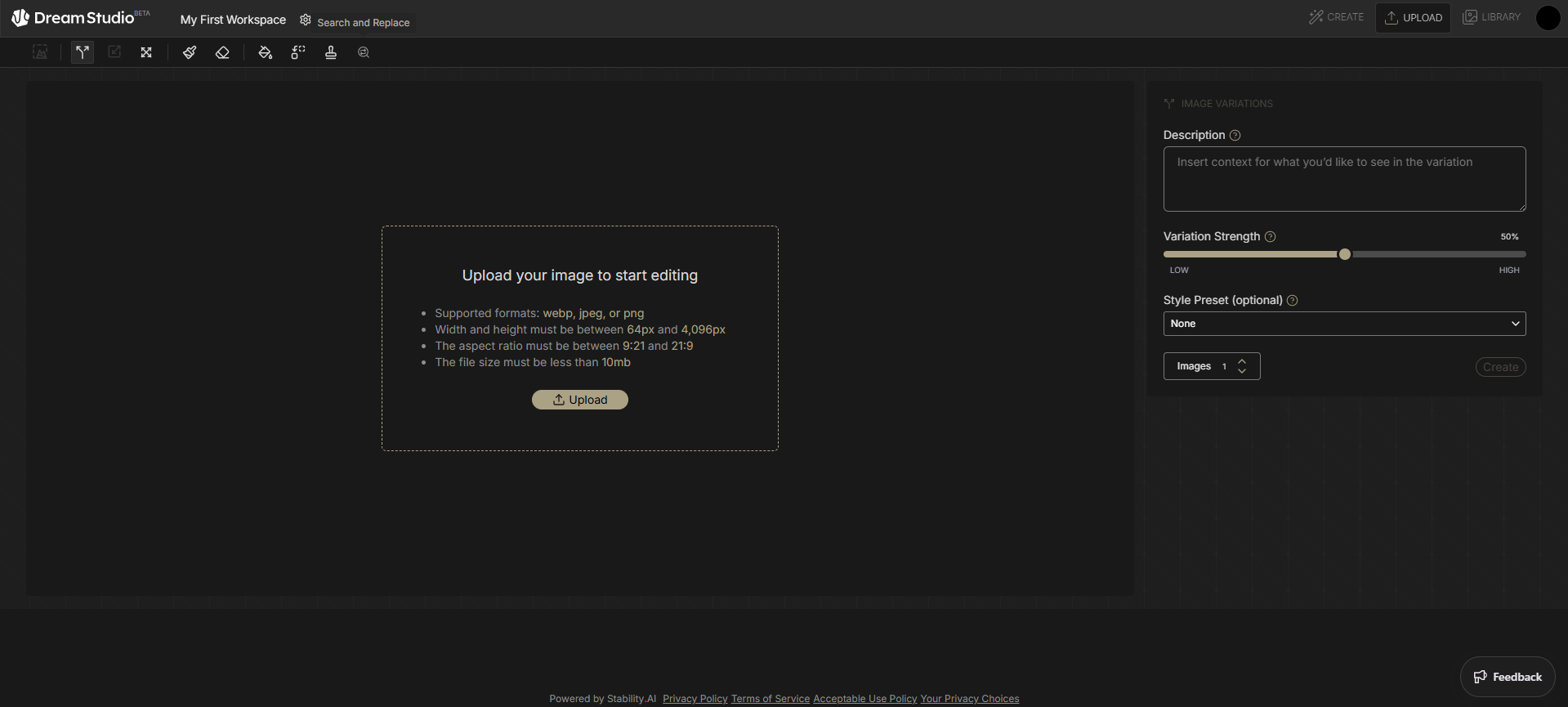

先ほど紹介した、生成した画像から「Edit」を選択するほか、手持ちの画像を直接加工することもできます。その場合は画面右上の「UPLOAD」をクリックしましょう。生成画面に戻る場合は「CREATE」、「LIBRARY」には今まで生成した画像がまとめられています。

左上には加工メニューがあります、左から順に解説していきます。

「Re-Roll」

Dream Studioで生成した画像のみ有効です。元のプロンプトなどの情報を保持したまま生成しなおして別の画像を生成します。

「Remove Background」

背景を切り抜いて、透過させる機能です。人の画像なら正確に認識できますが、メインとなる被写体があいまいな画像をきれいに抜くのは少し苦手です。アイコンを押せばすぐ開始され、黒と灰の市松模様になったところが透過されているということです。

「Variations」

右側の欄にプロンプトを入力し、画像の差分を生成します。「Reference Image」とほぼ同じで、元画像の特徴を保ちつつ少し変化を加える機能です。あまり大きく変化はしません。

「Upscale」

画像の解像度を上げる機能。

「Resize」

画像を拡張する機能。比率の変更や、拡張される領域にどういったものを描写するかをプロンプトで指定することができる。

「Inpaint」

指定した領域にプロンプトで指示したものを描き足す機能。

「Erase」

指定した領域に映っているものを消す機能。

「Recolor」

プロンプトで指示した場所の色を変更する機能。

「Structure」

元画像の構図や形状を参考にしつつ、プロンプトに基づいて大きく描き変える機能。先述の2つの機能と違って、「Strength」を100%に設定してやっと面影が残る程度である。

「Match Style」

元画像の画風や雰囲気を参考にしつつ、プロンプトに基づいて別のものを描く。こちらは「Strength」を0%に近づけるほど元の絵に近くなる。

「Search and Replace」

画像の被写体を、プロンプトを入力して置き換える機能。

Dream Studio BETAの機能紹介は以上になります。

料金プラン・アカウント設定

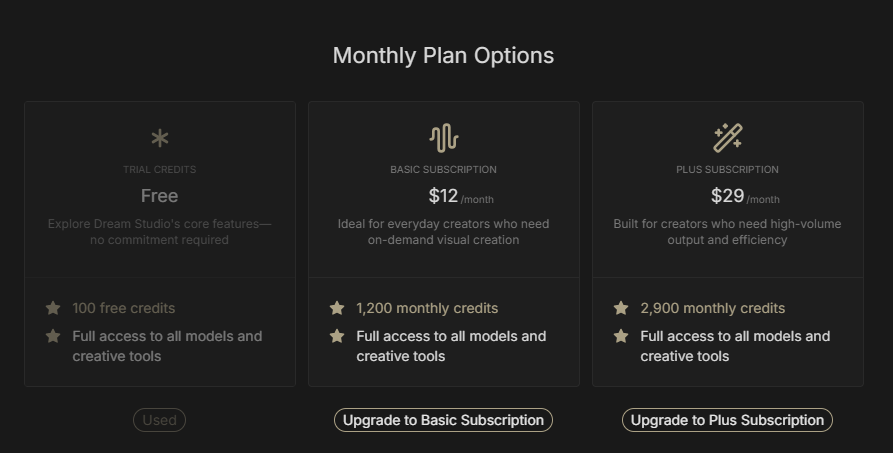

画像を生成するには「クレジット」を消費します。アカウントを作成した時点では無料体験分として100クレジット付与されますが、これを使い切ってしまうと利用することができなくなるため、必要に応じて有料プランに加入して追加クレジットを入手しましょう。

Dream Studioでは料金によって制限される機能などはないため、純粋に自分がどれだけ生成するかと相談しましょう。

また、生成サイズやモデルによって消費クレジットが異なるため、基本設定であれば100クレジットで15~20枚ほど生成できますが、より詳細な設定をするともっと少ない枚数で制限に達してしまう可能性もあります。

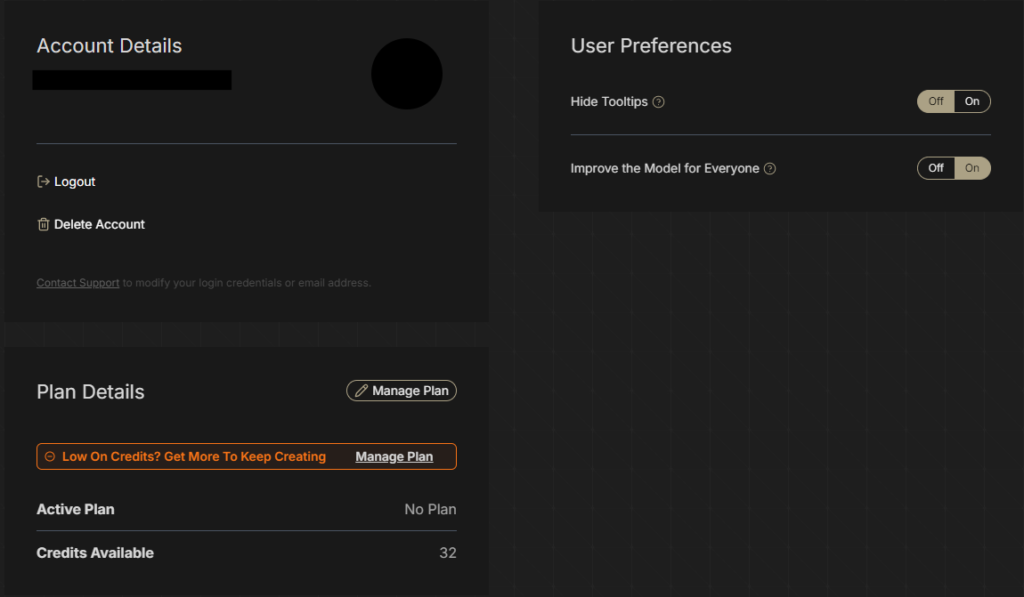

アカウント設定は画面右上のアイコン画面をクリックすると表示されるメニューの「Settings」からいけます。

「Delete Account」からアカウントの削除が行えます。確認のために指定された文字を入力する必要がありますが、不要になったらすぐ削除できるため、安心です。

「Plan Details」ではサブスクプランの設定ができます。

「Hide Tooltips」をOnにすると作成画面に出てくる説明が非表示になります。

「Improve the Model for Everyone」はサービス向上のために、ユーザーの操作履歴や、生成された画像、アップロードした画像を匿名で収集することを許可するかどうかの設定です。個人が趣味で使う範疇では問題にはなりませんが、誰かの顔写真や、個人情報や企業情報などをアップロードすると、それがAIの学習等に利用される可能性があります。デフォルトだとOnになっているため、気になる方はOffにしておくことをおすすめします。

ここまではDream Studio BETAの基本的な使い方について紹介してきました。従来のDream StudioはUIはBETAとは異なりますが、基本的な機能は同じなので、この記事の内容を覚えておけば問題なく使えると思います。

プロンプト入力のコツ

今回紹介した画像は特記してなければ「1girl, black hair, red eyes, ponytail」と入力しました。

繰り返しになりますが、基本的なルールとしては、英単語や短いフレーズをカンマ区切りで入力。スペースだけだとひとつなぎのフレーズと認識されてしまいます。モデルやUIによっては日本語や、長い文章にも対応している場合があります。

プロンプトは画像生成AIを利用するにあたって最も重要と言えるでしょう。AIに生成してほしいものをプロンプトとして表現できなければ、思ったような結果は得られません。

この記事では解説のために簡易的なプロンプトのみを例としてきましたが、最後に具体的なプロンプトの例や、より高品質な画像を生成するための方法やを紹介します。

品質に関するプロンプト

ネガティブプロンプト推奨のものは斜体で記載しますが、生成したいイメージによってはすべてがネガティブプロンプトにもなりえますし、その逆もあります。

| masterpiece, best quality, high quality | 絵としてクオリティの高いものを生成したいときに使用。何も考えずに使えるが、絵柄の幅が狭くというデメリットもある。好みで減らしたりしよう |

| hyper detailed | ディティール(細部)が詳細に描画される |

| realistic | 写実的な絵画風になる |

| photorealistic | 写真のようにリアルになる |

| anime | アニメ・イラスト風になる |

| worst quality, low quality, bad | 低品質なものを指す |

| error | 絵としておかしい描写 |

| extra | 指や手足が過多になる |

| missing | 指や手足が過少になる |

| watermark | 透かしのようなものが写り込む |

| text | 文字(のようなもの)が写り込む。 |

画角に関するプロンプト

画角や後述のポーズの指定には特に生成する画像の縦横比が重要になります。例えば、横長で「standing, full body」を入れると、背景に余計なものが写り込んだり、被写体が遠くなって細部があいまいになってしまったりなどの問題が起きやすくなります。構図に合わせて縦長、横長を指定するときれいな画像を作る近道になります。

| front view | 正面からの画角になる |

| side view / from side | 横から、どちらでも |

| back view / from behind | 後ろから |

| from above | 上から、俯瞰 |

| from below | 下から、煽り |

| full body | 全身が写る |

| upper body | 上半身のみが写る |

人物の外見やポーズに関するプロンプト

髪や目の色に関してはそのまま「green hair, pink eyes」と色を指定すればよいが、あまり厳密な色の指定はできません。「sky blue eyes」と入れると水色の瞳にはなりますが、背景にきれいな青空の屋外が生成されやすくなるなど、ほかの要素に干渉することもあります。そういうのを求めていないときはネガティブプロンプトとして「sky」を指定したり、「indoors(屋内)」や「classroom(教室)」など屋内であることを指定するなどして工夫を凝らしましょう。

髪型編

| short hair | 女の子だと、あごぐらいまでの長さになる |

| medium hair | 肩に付いたり付かなかったりするぐらい |

| long hair | とりあえず長くなる |

| bald | 坊主 |

| bob cut | ボブカット |

| hair pulled back | オールバック |

| braid | おさげ |

| ponytail | ポニテ |

| twintail | ツインテール |

| half updo | ハーフアップ |

| wavy hair | パーマ |

表情編

| smile | 笑顔 |

| little smile | ほほえむ |

| laugh | 口を開けて笑う |

| tears | 涙をながす |

| crying | 泣きじゃくる |

| angry | 怒る |

| sad | 悲しむ |

| embarrassed | 恥ずかしがる |

| flustered | 慌てる、驚く |

| expressionless | 無表情 |

| open eyes / mouth | 目・口を開ける |

| closed eyes / mouth | 目・口を閉じる |

| half-closed eyes | 半目になる |

| looking at viewer | カメラ目線 |

| looking up / down | 見上げる・見下ろす |

| averting eyes | 目をそらす |

| looking at ~ | ~のほうを見る。物を指定できる |

ポーズ編

| standing | 立ち姿、基本 |

| slouching | 前かがみ |

| all fours | 四つん這い |

| sitting | 座る。sitting on ~で場所を指定できる |

| yokozuwari | 横座り、女の子座りとも |

| hug own knees | 体育座り、sittingと組み合わせ |

| seiza | 正座 |

| indian style | あぐら |

| prone | うつ伏せ |

| on back | 仰向け |

ここにあるのはほんの一例です。リストにないものは英語翻訳した単語を入れれば認識することがほとんどですが、AIが学習したデータに存在しないものはどう頑張っても生成することはできません。そういった場合でも、類語を試してみたりすれば生成されることもあるので、いろいろ試してみましょう。

また、(任意のプロンプト:1.5)と、カッコで指定してコロンと数字を入力すると、そのプロンプトの重要度を変えることができます。

(記号はすべて半角入力してください。また、モデルやUIによっては適応されない場合もあります。)

1.0より大きくすればより強く反映され、逆に小さくすれば影響は小さくなります。大きくしすぎると絵が崩壊してしまうので、どんなに高くても1.8までにしましょう。逆にそこまで大きくしても影響がないものは、AIがそのプロンプトに対応するデータを学習していないということです。

また、プロンプトは先に入力されたものが反映されやすい傾向にあります。微々たる差ではありますが、管理のしやすさもかねて、プロンプトの目的別に並ぶようにすれば、自分がどういう指示を出しているのかを把握しやすくなります。

より詳細なプロンプトに関しては別の記事にて紹介する予定ですので、そちらもぜひご確認ください。

最後に

今回はStable Diffusionを利用するための1つの手段としてDream Studioの紹介をしてきました。

Dream Studioは開発元のStability AIが直接運営しているため、安心して利用できるクラウドAPIですが、ここ以外にもStable Diffusionを提供しているサイトは多数あります。

しかし、中には機能を十分に試せなかったり、クレジットカードなどの個人情報を狙った悪質なサイトがある可能性があります。利用料金などもサイトによって異なるため、利用する前に信頼できるサービスなのか必ず調べるようにしましょう。

我々は今後も安心して利用できるサービスについて紹介していきます。

Dream Studioで生成した画像は商用利用が可能ですが、AIによる画像生成は意図せず第三者の著作権・肖像権・商標権などを侵害するリスクもあります。また、クラウドAPIの提供元で別途規約が異なる場合もありますので、公開・商用利用の際は、各サービスの利用規約や関連する法律を必ず確認してください。

最後にDream Studioで生成した画像をいくつか掲載します。

【関連記事】

ウェールズの研究者が、ジャガイモ疫病と戦うためのAIアプリ「DeepDetectプロジェクト」を開発している。

ジャガイモ疫病は世界のジャガイモ作物の約20%の損失を引き起こし、総額45億ドル以上の経済的損失をもたらしている。この病気はPhytophthora infestans(フィトフトラ・インフェスタンス)という病原体によって引き起こされる。

従来の検査は労働集約的で費用がかかり、ヒューマンエラーが発生しやすいため、見逃された場合は病気が畑全体に広がる可能性がある。新しいAIアプリはスマートフォンのカメラを使用してジャガイモの葉の変化を検出し、農家が通常現れる前に病気の兆候を察知できるようにする。

ウェールズでは17,000ヘクタール以上がジャガイモ栽培に充てられているとされる。研究者は農家からの直接的なフィードバックを収集中で、早期診断により農家がより迅速に病気と戦えるようになることを期待している。この技術は将来的にジャガイモを超えて農業産業の他分野にも拡張される可能性がある。

From: ![]() Researchers Want To Use AI To Fight Potato Blight

Researchers Want To Use AI To Fight Potato Blight

【編集部解説】

このニュースが注目すべき理由は、農業分野におけるAI活用の新たな地平を示している点にあります。特に食料安全保障の観点から、ジャガイモ疫病という世界的な課題に対する革新的なアプローチが提示されています。

従来の農業では、病気の検出は人間の目視に頼る部分が大きく、症状が目に見えるようになった時点では既に手遅れになることが多々ありました。Phytophthora infestans(フィトフトラ・インフェスタンス)という病原体によるジャガイモ疫病は、1845年のアイルランド大飢饉の原因ともなった歴史的な脅威であり、現在でも湿度の高い条件下では数週間で作物を全滅させる可能性があります。

アベリストウィス大学のDeepDetectプロジェクトは、コンピュータビジョンと機械学習を組み合わせて、スマートフォンのカメラを通じてジャガイモの葉の微細な変化を検出し、人間の目では見えない初期段階での病気の兆候を捉えることを目指しています。この技術の革新性は、従来の広域予防散布からtargeted intervention(標的介入)へのパラダイムシフトにあります。

ある報告によると、ウェールズの農家は予防的な殺菌剤散布に年間500万ポンド以上を費やしていると推定されています。このAIシステムが実現すれば、必要な場所にのみピンポイントで対策を講じることが可能になり、大幅なコスト削減と環境負荷軽減が期待できます。

技術面では、このシステムがリアルタイム位置情報と組み合わされることで、location-specific disease diagnoses(場所特有の病気診断)を提供できる点が重要です。これにより、農家は自分の畑の特定の区画に対して即座に対応できるようになります。

興味深いのは、開発チームが最初から農家との共同設計アプローチを採用していることです。これにより、技術的に優れていても実用性に欠けるという、多くの農業技術製品が陥りがちな問題を回避しようとしています。

将来的な展望として、この技術は他の作物や病害にも応用可能とされており、農業分野におけるpredictive analytics(予測分析)の基盤技術となる可能性があります。特に気候変動により病害の発生パターンが変化する中で、このような早期警告システムの重要性はますます高まるでしょう。

一方で、農家のデジタルリテラシーや通信インフラの整備状況、データプライバシーの問題など、実装に向けた課題も存在します。また、AIの判断精度やfalse positive(偽陽性)・false negative(偽陰性)のリスクについても、実用化に向けて慎重な検証が必要です。

この研究はウェールズ政府のSmart Flexible Innovation Support(SFIS)プログラムの支援を受けており、政府レベルでも農業のデジタル変革が重要政策として位置づけられていることがわかります。世界人口の増加と気候変動という二重の課題に直面する現代において、このような技術革新は単なる効率化を超えた、人類の生存戦略としての意味を持っています。

【用語解説】

potato blight(ジャガイモ疫病)

Phytophthora infestansという病原体によって引き起こされるジャガイモの致命的な病気である。感染した植物から数日で広大な畑を全滅させる能力を持ち、1845年のアイルランド大飢饉の原因ともなった歴史的な脅威である。

machine learning(機械学習)

データから自動的にパターンを学習し、予測や分類を行うAI技術である。農業分野では作物の病気検出や収穫量予測などに活用されている。

targeted intervention(標的介入)

特定の問題が発生している場所にのみピンポイントで対策を講じるアプローチである。従来の広域予防散布と対比される効率的な手法である。

【参考リンク】

Aberystwyth University(アベリストウィス大学)(外部)

ウェールズにある公立大学で、今回のDeepDetectプロジェクトを主導している。農業科学や環境科学の分野で高い評価を受けている。

Welsh Government(ウェールズ政府)(外部)

イギリスの構成国の一つであるウェールズの地方政府。Smart Flexible Innovation Supportプログラムを通じて農業技術革新を支援している。

【参考動画】

【参考記事】

Farming’s new weapon: AI app to spot potato blight before it hits(外部)

ウェールズの科学者が開発中のDeepDetectプロジェクトについて詳しく報じた記事。予防散布に年間527万ポンドを費やしているウェールズの現状や具体的な情報を提供している。

Potato blight warning app to use AI to help farmers – BBC News(外部)

BBCによるDeepDetectプロジェクトの報道。ジャガイモが世界で4番目に重要な主食作物であることや食料安全保障の観点からこの技術の重要性を説明している。

Agriculture Technology News 2025: New Tech & AI Advances(外部)

2025年の農業技術トレンドについて包括的に分析した記事。世界の農場の60%以上がAI駆動の精密農業技術を採用すると予測している。

Phytophthora infestans: An Overview of Methods and Attempts(外部)

Phytophthora infestansの科学的研究論文。病原体の遺伝子構造や高い変異率について詳細な説明を提供している。

【編集部後記】

農業とAIの融合は、私たちの食卓の未来を大きく変える可能性を秘めています。スマートフォンひとつで作物の病気を早期発見できる時代が目前に迫っている今、皆さんはどんな農業の未来を想像されますか?

食料安全保障という人類共通の課題に対して、テクノロジーがどこまで貢献できるのか、一緒に考えてみませんか?また、このような技術が実用化された際、消費者である私たちの生活にはどのような変化が訪れると思われますか?ぜひSNSで皆さんの率直なご意見をお聞かせください。

法執行技術企業Axon社が開発したAIソフトウェア「Draft One(ドラフト・ワン)」が全米の警察署で導入されている。

このツールは警察官のボディカメラの音声認識を基に報告書を自動作成するもので、Axon社の最も急成長している製品の一つである。コロラド州フォートコリンズでは報告書作成時間が従来の1時間から約10分に短縮された。Axon社は作成時間を70%削減できると主張している。

一方で市民権団体や法律専門家は懸念を表明しており、ACLU(米国市民自由連合)は警察機関にこの技術から距離を置くよう求めている。ワシントン州のある検察庁はAI入力を受けた警察報告書の受け入れを拒否し、ユタ州はAI関与時の開示義務を法制化した。元のAI草稿が保存されないため透明性や正確性の検証が困難になるという指摘もある。

From: ![]() Cops Are Using AI To Help Them Write Up Reports Faster

Cops Are Using AI To Help Them Write Up Reports Faster

【編集部解説】

このニュースで紹介されているAxon社のDraft Oneは、単なる効率化ツールを超えた重要な議論を巻き起こしています。

まず技術的な側面を整理しておきましょう。Draft Oneは、警察官のボディカメラ映像から音声を抽出し、OpenAIのChatGPTをベースにした生成AIが報告書の下書きを作成するシステムです。Axon社によると、警察官は勤務時間の最大40%を報告書作成に費やしており、この技術により70%の時間を削減できると主張しています。

しかし、実際の効果については異なる報告が出ています。アンカレッジ警察署で2024年に実施された3ヶ月間の試験運用では、期待されたほどの大幅な時間短縮効果は確認されませんでした。同警察署のジーナ・ブリントン副署長は「警察官に大幅な時間短縮をもたらすことを期待していたが、そうした効果は見られなかった」と述べています。審査に要する時間が、報告書生成で節約される時間を相殺してしまうためです。

このケースは単独のものではありません。2024年にJournal of Experimental Criminologyに発表された学術研究でも、Draft Oneを含むAI支援報告書作成システムが実際の時間短縮効果を示さなかったという結果が報告されています。これらの事実は、Axon社の主張と実際の効果に重要な乖離があることを示しています。

最も重要な問題は透明性の欠如です。Draft Oneは、意図的に元のAI生成草案を保存しない設計になっています。この設計により、最終的な報告書のどの部分がAIによって生成され、どの部分が警察官によって編集されたかを判別することが不可能になっています。

この透明性の問題に対応するため、カリフォルニア州議会では現在、ジェシー・アレギン州上院議員(民主党、バークレー選出)が提出したSB 524法案を審議中です。この法案は、AI使用時の開示義務と元草案の保存を義務付けるもので、現在のDraft Oneの設計では対応できません。

法的影響も深刻です。ワシントン州キング郡の検察庁は既にAI支援で作成された報告書の受け入れを拒否する方針を表明しており、Electronic Frontier Foundation(EFF)の調査では、一部の警察署ではAI使用の開示すら行わず、Draft Oneで作成された報告書を特定することができないケースも確認されています。

技術的課題として、音声認識の精度問題があります。方言やアクセント、非言語的コミュニケーション(うなずきなど)が正確に反映されない可能性があり、これらの誤認識が重大な法的結果を招く可能性があります。ブリントン副署長も「警察官が見たが口に出さなかったことは、ボディカメラが認識できない」という問題を指摘しています。

一方で、人手不足に悩む警察組織にとっては魅力的なソリューションです。国際警察署長協会(IACP)の2024年調査では、全米の警察機関が認可定員の平均約91%で運営されており、約10%の人員不足状況にあることが報告されています。効率化への需要は確実に存在します。

しかし、ACLU(米国市民自由連合)が指摘するように、警察報告書の手書き作成プロセスには重要な意味があります。警察官が自らの行動を文字にする過程で、法的権限の限界を再認識し、上司による監督も可能になるという側面です。AI化により、この重要な内省プロセスが失われる懸念があります。

長期的な視点では、この技術は刑事司法制度の根幹に関わる変化をもたらす可能性があります。現在は軽微な事件での試験運用に留まっているケースが多いものの、技術の成熟と普及により、重大事件でも使用されるようになれば、司法制度全体への影響は計り知れません。

【用語解説】

Draft One(ドラフト・ワン):

Axon社が開発したAI技術を使った警察報告書作成支援ソフトウェア。警察官のボディカメラの音声を自動認識し、OpenAIのChatGPTベースの生成AIが報告書の下書きを数秒で作成する。警察官は下書きを確認・編集してから正式に提出する仕組みである。

ACLU(American Civil Liberties Union、米国市民自由連合):

1920年に設立されたアメリカの市民権擁護団体。憲法修正第1条で保障された言論の自由、報道の自由、集会の自由などの市民的自由を守る活動を行っている。現在のDraft Oneに関する問題について警告を発している。

Electronic Frontier Foundation(EFF):

デジタル時代における市民の権利を守るために1990年に設立された非営利団体。プライバシー、言論の自由、イノベーションを擁護する活動を行っている。Draft Oneの透明性問題について調査・批判を行っている。

IACP(International Association of Chiefs of Police、国際警察署長協会):

1893年に設立された世界最大の警察指導者組織。法執行機関の専門性向上と公共安全の改善を目的として活動している。全米の警察人員不足に関する調査を実施している。

【参考リンク】

Axon公式サイト(外部)

Draft Oneの開発・販売元でProtect Lifeをミッションに掲げる法執行技術企業

Draft One製品ページ(外部)

生成AIとボディカメラ音声で数秒で報告書草稿を作成するシステムの詳細

ACLU公式見解(外部)

AI生成警察報告書の透明性とバイアスの懸念について詳細に説明した白書

EFF調査記事(外部)

Draft Oneが透明性を阻害するよう設計されている問題を詳細に分析

国際警察署長協会(外部)

全米警察機関の人員不足状況と採用・定着に関する2024年調査結果を公開

【参考記事】

アンカレッジ警察のAI報告書検証 – EFF(外部)

3ヶ月試験運用で期待された時間短縮効果が確認されなかった結果を詳述

AI報告書作成の効果検証論文 – Springer(外部)

Journal of Experimental CriminologyでAI支援システムの時間短縮効果を否定

警察署でのAI活用状況 – CNN(外部)

コロラド州フォートコリンズでの事例とAxon社の70%時間短縮主張を報告

全米警察人員不足調査 – IACP(外部)

1,158機関が回答し平均91%の充足率で約10%の人員不足状況を報告

カリフォルニア州AI開示法案 – California Globe(外部)

SB 524法案でAI使用時の開示義務と元草稿保存を義務付ける内容を詳述

ACLU白書について – Engadget(外部)

フレズノ警察署での軽犯罪報告書限定の試験運用について報告

アンカレッジ警察の導入見送り – Alaska Public Media(外部)

副署長による音声のみ依存で視覚的情報が欠落する問題の具体的説明

【編集部後記】

このDraft Oneの事例は、私たちの身近にある「効率化」という言葉の裏に隠れた重要な問題を浮き彫りにしています。特に注目すべきは、Axon社が主張する効果と実際の現場での検証結果に乖離があることです。

日本でも警察のDX化が進む中、同様の技術導入は時間の問題かもしれません。皆さんは、自分が関わる可能性のある法的手続きで、AIが作成した書類をどこまで信頼できるでしょうか。また、効率性と透明性のバランスをどう取るべきだと思いますか。

アンカレッジ警察署の事例のように、実際に試してみなければ分からない課題もあります。ぜひSNSで、この技術に対する率直なご意見をお聞かせください。私たちも読者の皆さんと一緒に、テクノロジーが人間社会に与える影響について考え続けていきたいと思います。

AI(人工知能)ニュース

Anthropic Claude Sonnet 4、100万トークンのコンテキスト対応でソフトウェアプロジェクト全体の一括解析が可能に

Published

9か月 agoon

2025年8月13日By

TaTsu

2025年8月12日、AnthropicはClaude Sonnet 4が1リクエストで最大100万トークンを処理可能になったと発表した。

Public BetaとしてAnthropicのAPIとAmazon Bedrockで提供し、Google CloudのVertex AI対応は予定中である。75,000行超のコードベース解析が可能となり、内部テスト「needle in a haystack」で100%の正確性を達成した。

価格は入力200Kトークン以下が$3/M、出力が$15/M、超過分は入力$6/M、出力$22.5/Mとなる。Menlo Venturesの調査ではAIコード生成市場でAnthropicは42%、OpenAIは21%のシェアを持つ。主要顧客はCursorとGitHub Copilotで、年間収益ランレート50億ドルのうち約12億ドルを占める。初期利用はTier 4やカスタムレート制限のAPI顧客、Fortune 500企業などである。

From: ![]() Claude can now process entire software projects in single request, Anthropic says

Claude can now process entire software projects in single request, Anthropic says

【編集部解説】

AnthropicがClaude Sonnet 4に最大100万トークンのコンテキスト(文脈)処理を開放しました。単一リクエストで約75,000行のコードや約75万語のドキュメントを一気に読み込める規模で、APIおよびAmazon Bedrock経由のPublic Betaとして段階的に展開されています。これにより、これまで分割前提だった大規模リポジトリや多数文書の横断的な関連把握が、1回の入出力で可能になります。

技術的には、長文脈での「needle in a haystack(干し草の山の中の針)」的検索・想起の正確性が論点です。Anthropicは内部評価で100%の再現性を謳いますが、これはあくまで社内テストであり、実運用におけるコード異臭検知や設計上のトレードオフ把握など、多層的な推論の持続性は現場検証が不可欠です。ただし、プロジェクト全体像を”丸ごと”見渡せること自体は、ファイル粒度の分割では失われがちだった依存関係と設計意図を保ったまま提案できる余地を広げます。

実装・料金面では、200Kトークン以下は従来の$3/MTok(入力)・$15/MTok(出力)に据え置き、200K超から$6/MTok・$22.50/MTokへ切り替わる二段制です。長文脈のβ利用は当面Tier 4およびカスタム制限の組織が対象で、プロンプトキャッシング(prompt caching(プロンプトの再利用キャッシュ))と併用することでリピート照会型ワークロードの総コストを抑制できる設計です。この「キャッシュ×長文脈」によるRAG代替のコスト・品質最適化は、法務・金融・製造のナレッジ資産を持つ企業にとって実践的な選択肢になり得ます。

市場文脈では、コード生成が企業導入の主用途として伸び、Menlo Ventures調査でAnthropicのコード生成シェアは42%、OpenAIは21%とされています。企業は価格より性能を優先し、より高性能モデルへの素早いアップグレードが常態化しています。一方で、価格攻勢を強める競合(例:GPT-5)や、プラットフォーム戦略におけるアライアンスの力学は、モデル採用の流動性を高める要因となります。

できるようになることは明確です。第一に、リポジトリ全体の設計レビュー、リファクタリング計画、仕様と実装の整合性監査を「文脈を保ったまま」一気通貫で回せます。第二に、数百ファイル規模の文書群からの合意形成資料やリスク論点の抽出など、関係性を前提とする要約・統合がしやすくなります。第三に、ツール呼び出しを跨いだエージェント運用で、長いワークフローの一貫性と再現性を保ちやすくなります。

留意すべきリスクもあります。長文脈は「見えすぎるがゆえの錯覚」を生みやすく、誤った前提の連鎖や過剰一般化が交じると、広範囲に影響する提案ミスになり得ます。加えて、過去バージョンで観測された望ましくない振る舞いの教訓から、安全性設計は今後も注視が必要です。ベータ段階では、重要判断におけるヒューマン・イン・ザ・ループを厳格に保つべきです。

規制・ガバナンス面では、長文脈化に伴い入力データの守備範囲が拡大します。権限分離、機密区分、データ最小化の実装が不十分だと、不要な個人情報・営業秘密まで取り込むリスクが増します。監査可能性(誰が・いつ・何を入力し、どの判断がなされたか)を担保するためのログ設計や、キャッシュのTTL・アクセス制御は、モデル選定と同列の経営課題です。

長期的には、RAG前処理中心の「情報を選んでから渡す」設計から、長文脈を前提に「まず全体を見せ、モデル自身に選ばせる」設計への再編が進みます。これは、情報アーキテクチャとMLOpsの分業を再定義し、エージェント編成・権限設計・コスト会計の枠組みまで影響を与えます。GeminiやOpenAIも大規模コンテキストの路線にあり、長文脈×価格×推論性能の三つ巴は当面の焦点であり続けるでしょう。

最後に、なぜ今か。モデル性能の頭打ち議論が出る中で、「入力側の律速」を外すことは実務価値に直結します。プロダクトロードマップ、設計思想、運用手順、テスト資産、ナレッジの「全体」を理解したうえで提案できるAIは、開発現場の意思決定速度と品質を底上げします。長文脈は魔法ではありませんが、現場の「分割に伴う損失」を削る現実的なテコになります。

【用語解説】

コンテキストウィンドウ(context window)

モデルが一度のリクエストで保持・参照できる入力の範囲のこと。

トークン(token)

テキストを分割した最小単位で、課金やモデルの処理量の基準となる。

needle in a haystack(干し草の山の中の針)

大量テキスト中の特定情報を探索する内部評価手法の通称。

Public Beta(公開ベータ)

一般開放された試験提供段階で、正式版前の段階を指す。

プロンプトキャッシング(prompt caching)

繰り返し使う大規模プロンプトをキャッシュして遅延とコストを削減する仕組み。

RAG(Retrieval-Augmented Generation)

検索・取得結果を補助情報として生成に用いる方式。

リポジトリ横断コード解析

リポジトリ全体を読み込み、依存関係や設計をまたいで解析・提案すること。

コンテキスト対応エージェント

長いワークフローや多数のツール呼び出しにわたり文脈を保持するAIエージェント。

【参考リンク】

Anthropic(外部)

人工知能モデルClaudeを提供する企業で、Sonnet 4の1Mトークン文脈を発表している。

Claude Sonnet 4: 1Mトークン対応発表(外部)

Sonnet 4の1Mトークン対応、ユースケース、価格調整、提供範囲を案内する発表ページである。

Anthropic API Pricing(外部)

Sonnet 4の長文脈価格やティア条件、バッチ割引、キャッシュ適用などの詳細を示す。

Amazon Bedrock(外部)

複数基盤モデルを提供するAWSの生成AIサービスで、Claudeの提供も含む。

Google Cloud Vertex AI(外部)

Google CloudのAIプラットフォームで、基盤モデルの提供と統合機能を持つ。

【参考動画】

【参考記事】

Claude Sonnet 4 now supports 1M tokens of context(外部)

Sonnet 4が最大1Mトークンの文脈に対応し、リポジトリ全体の解析、文書群統合、コンテキスト対応エージェントなどのユースケースが拡張された。

Anthropic’s Claude AI model can now handle longer prompts(外部)

Sonnet 4が1Mトークンに対応し、約750,000語または75,000行規模の入力が可能になった。

Menlo Ventures – 2025 Mid-Year LLM Market Update(外部)

企業LLM市場のシェア変動、API支出の倍増、コード生成の台頭、Anthropicのコード生成シェア42%などを提示。

Techmeme summary: Anthropic updates Claude Sonnet 4(外部)

1Mトークンの文脈対応、約750K語/75K行、5倍拡張という要点を集約し、同日の報道の中心情報を短く示す。

Simon Willison: Claude Sonnet 4 now supports 1M tokens of context(外部)200Kと1Mでの二段価格、βヘッダー指定、Tier 4制限など、実装上の具体的留意点を補足し、他社(Gemini)の価格比較も紹介。

【編集部後記】

みなさんは、開発しているサービスやプロジェクトの全体像を、AIが一度に理解して提案してくれるとしたら、どんな活用を思い描きますか。75,000行のコードベースを分割せずに扱えることは、単なる効率化を超えた可能性を秘めています。

これまで、大規模なシステムの改善提案を得るためには、開発者が手作業でコードを分割し、重要な文脈を失うリスクを抱えながら作業していました。しかし今回のClaude Sonnet 4の長文脈対応により、プロジェクト全体の設計思想や依存関係を保ったまま、AIからの提案を受けられるようになります。

もちろん、200Kトークン超で$6/$22.50という価格設定は決して安くありません。しかし、分割作業に費やしていた時間コストや、文脈を失うことで生じる品質リスクを考慮すれば、多くの企業にとって合理的な投資と言えるでしょう。

この技術がもし皆さんの職場や個人プロジェクトに導入されたら、どんな変化が起こるのか。コードレビューの質は向上するのか、設計判断のスピードは上がるのか。そして何より、開発者の創造性がより高い領域に向かうのか。ぜひ想像しながら、この技術の可能性について考えてみてください。