AI(人工知能)ニュース

Google colabを利用したStable Diffusion Web UI導入方法-PCスペック不問で画像生成

Published

10か月 agoon

By

りょうとく

Google ColabでStable Diffusion Web UIを利用すれば、ほぼ無制限に大量の画像を生成できます。導入方法や使い方、利用の制限時間、仮想環境であることによる注意点も解説します。

Stable Diffusionとは?

「Stable Diffusion(ステーブルディフュージョン)」は、2022年8月にイギリスの企業「Stability AI(スタビリティエーアイ)」によってリリースされた、商用利用可能なオープンソースの画像生成AIです。

これは「拡散モデル」と呼ばれる機械学習アルゴリズムを基盤としています。拡散モデルとは、ランダムなノイズ画像から、大量の画像から学習したデータを元に少しずつノイズを取り除いていくことで、指示(プロンプト)に合った画像を生成する技術です。Stable Diffusionの特徴は以下の点にあります。

- オープンソース: ソースコードが公開されているため、研究者や開発者が自由に改良や拡張が可能

- 最小限のリソース: 比較的少ないコンピューティングリソースで高品質な画像生成が可能

- 多様な応用: テキストから画像生成(Text-to-Image)だけでなく、画像から画像生成(Image-to-Image)、画像修復など幅広い機能をサポート

- コミュニティによる発展: 世界中の開発者によって様々なバージョンやカスタムモデルが開発され続けている

他のAI画像生成ツール(DALL-E 、Midjourney等)と比較すると、Stable Diffusionはローカル環境で動作させることができる点が大きな特徴です。これにより、パソコンに導入さえできてしまえばインターネット接続がなくても使用でき、プライバシーを保ちながら無制限に画像生成が可能になります。

オープンソースであるため、様々な企業がStable Diffusionを利用したサービスを展開したり、個人のパソコンで自由に利用することが可能です。アーティスト、デザイナー、マーケティング担当者、そして創作を楽しみたい一般ユーザーまで、幅広い層に活用されています。

画像生成には「プロンプト」と呼ばれる、AIに対する指示文を入力する必要があります。正式な呼び名ではありませんが「呪文」と呼ばれることも多いです。

Stable Diffusionを利用するには大きく分けて3つの方法があります。

1.クラウドAPI(Dream Studio)を利用する

無料でStable Diffusionを体験できる

継続的な利用にはサブスク加入が必須

2.GPUクラウドサービス(Google Colab)を利用する

一部制約はあるが大量生成すればコスパは良い

外部の環境に依存する点が多く、設定がやや複雑

☆本記事で紹介☆

3.ローカル環境で利用する

導入さえできてしまえば無制限に使える

要求されるPCスペックや知識のハードルが高い

今回は「2.GPUクラウドサービス(Google Colab)を利用する」方法について解説していきます。

7/11追記

Stability AIより規約更新が発表され、7/31以降、あらゆる性的コンテンツの生成が禁止となりました。詳しくは以下の記事をご確認ください。

※本記事の内容は2025年7月時点の情報です。大きな変更点は随時更新していきますが、モデルやUI、料金体系などはの詳細は必ず公式サイトや最新の情報も併せてご確認ください。

目次

導入方法

Google Colab(正式名称Google Colabratry)はGoogle社が提供している、誰でも簡単にPythonでのプログラミングができるJupyter notebook形式のGPUクラウドサービスでの一種です。

今回ご紹介するStable Diffusionを利用するための最もメジャーなUIである「AUTOMATIC1111」はオープンソースプロジェクトとしてGitHub上で開発されており、「AUTOMATIC1111」とは開発者のユーザー名で、正式な名称は「Stable Diffusion Web UI(by AUTOMATIC1111)」となります。

「AUTOMATIC1111」はPythonで開発されているため、Google Colabはまさにうってつけというわけです。

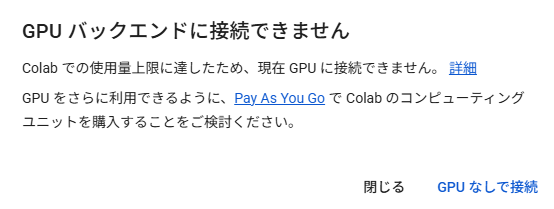

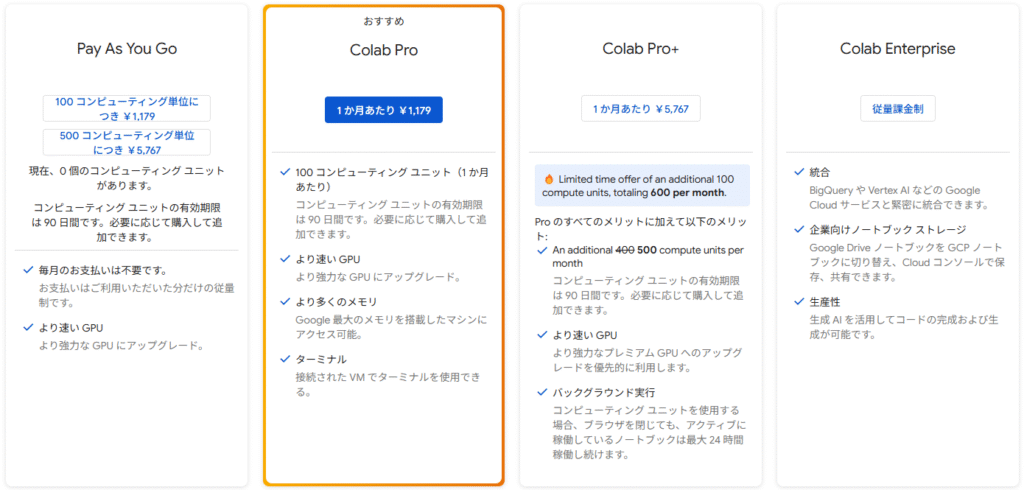

2025年5月現在、Stable Diffusion利用者増加のためGoogle Colabの無料版はStable Diffusionをサポート対象外としています。利用が制限されたり、動作が不安定になったりする可能性がありますので、可能であれば有料版の登録をしましょう。

加えて、Google Colabの仕様上、設定やデータは保存されないため、接続が切れるたびに最初からやりなおす必要があります。無料版では上記の理由などで突然セッションが切断されて画像が消えてしまったりするため、必ず気に入った生成画像はすぐ保存するようにしましょう。

まずはGoogle Colabにアクセスしましょう。

そうしたらまずこのようなウィンドウが出てくると思いますが、これは一旦キャンセルするか、ウィンドウの外をクリックして閉じてください。

次は画面左上の「ファイル」をクリックして「新しいノートブック」を選択してください

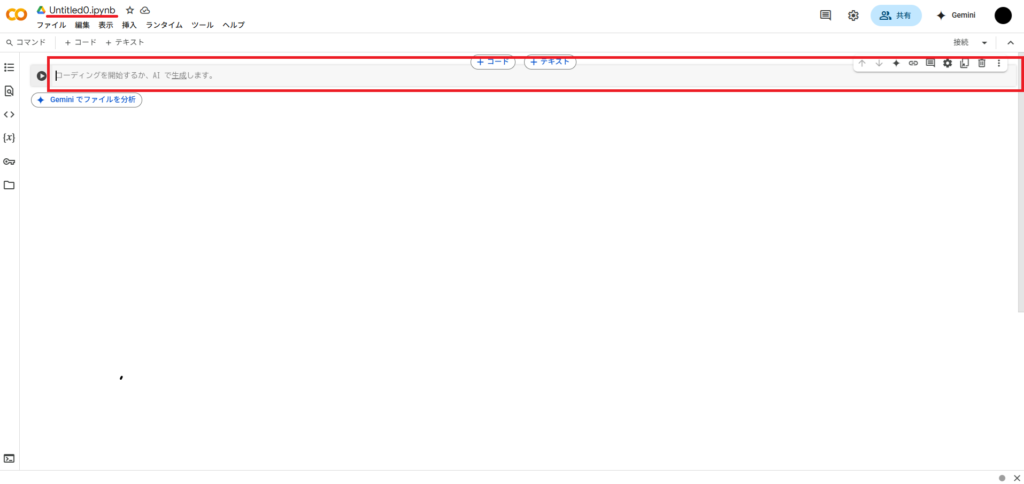

そうしたらコードを実行する画面になります。左上の「Untitled0.ipynd」のところを任意の名前に変更しておくと後から判別しやすくなります。

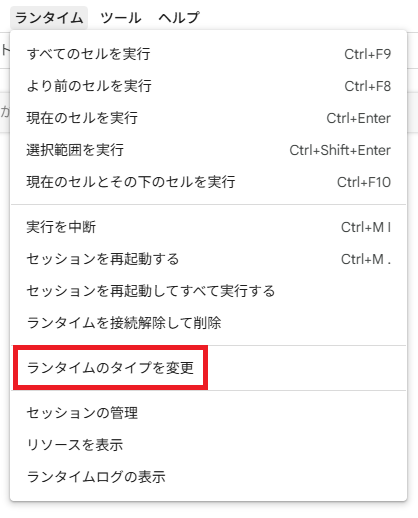

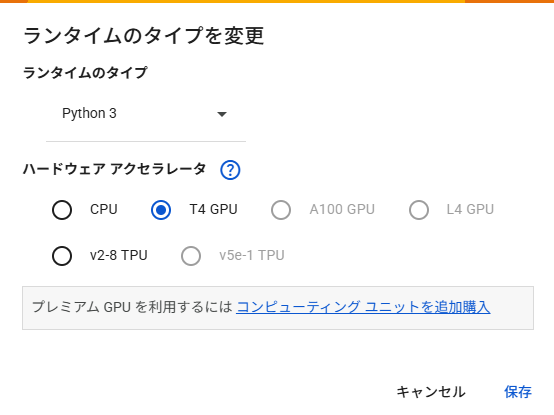

左上の「ランタイム」タブから「ランタイムのタイプを変更」を選択します。

ここで任意のGPUを選択してください。無料版なら「T4 GPU」のみになります。有料版ならより高性能な「A100 GPU」と「L4 GPU」も選択できますが、アクセスするための「コンピューティングユニット」の消費が大きくなり、稼働させられる時間が短くなってしまいます。

加えて、「T4 GPU」ではVRAM不足によって1024*1024レベルの大きな解像度で生成することができません。有料版を購入したなら自分が生成したいものに合わせて上位のGPUを選択するとよいでしょう。

注意としては、ここを変更するとすべての設定がリセットされます。生成した画像を含め、モデルデータやLoRAなどのデータをアップロードしていた場合も、すべて最初からやり直しになってしまいます。

ランタイムのタイプはデフォルトの「Python 3」のままで問題ありません

設定が済んだら次は「AUTOMATIC1111」のインストール準備になります。

画面内の赤い四角で囲んだところがプログラムコードを入力する欄になりますので、そこに以下のコードを入力して、左側の三角ボタンを押して実行しましょう。

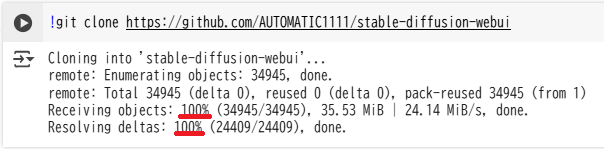

!git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui

これは「GitHub」という、ソフトウェア開発のためにソースコードを管理できるプラットフォーム上で公開されている「AUTOMATIC1111」をGoogle Colab上にコピーするコードになります。

Stable Diffusionはよくあるソフトウェアのようにどこかにダウンロードリンクがあって、ファイルをダウンロードして実行といった形式ではありません。Pythonでコードを実行する必要があります。

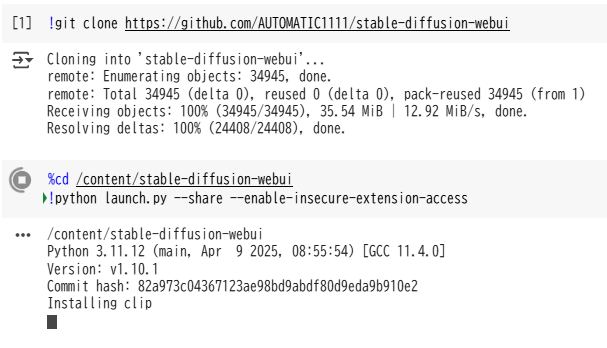

次に以下のコードで、「AUTOMATIC1111」のインストールと実行をします。

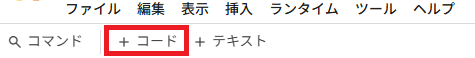

左上の「+コード」から新たな入力欄を追加して、実行してください。

%cd /content/stable-diffusion-webui

!python launch.py –share –enable-insecure-extension-access

長々と出てきますが、下のほうにスクロールして「Running on public URL」と出てくれば起動完了ですので、このURLをクリックしましょう。

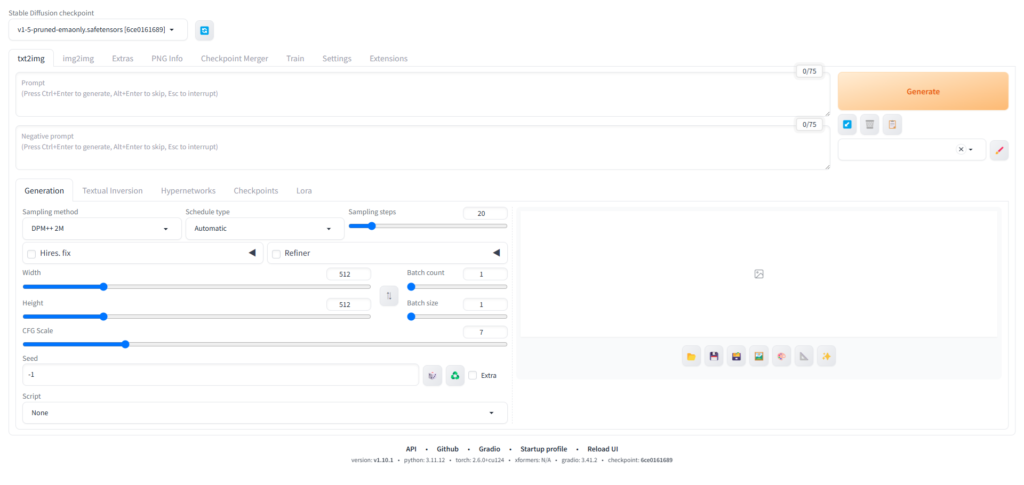

そうすると新しいタブで「AUTOMATIC1111」が開きます。

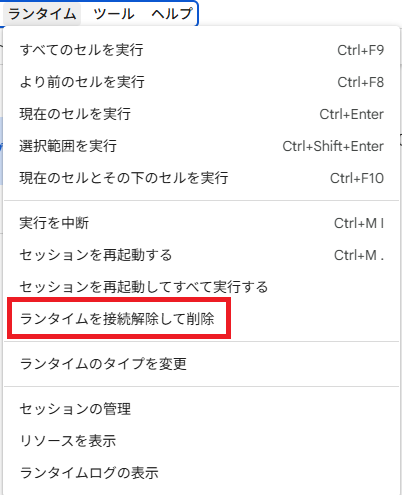

このセッションが接続されている限り、「コンピューティングユニット」が消費されていきます。使わない時間はGoogle Colabのタブに戻り、「ランタイム」タブから「ランタイムを接続解除して削除」することをおすすめしますが、切断するとインストールやアップロードしたもの、保存していない生成画像はすべて消えてしまいます。都度インストールからやり直さなければならないのがGoogle Colabの最大のデメリットともいえるでしょう。

一度設定してしまえば、次回開いたときにすでにコードの入力がされている状態になるので、順番に実行するだけで起動できます。

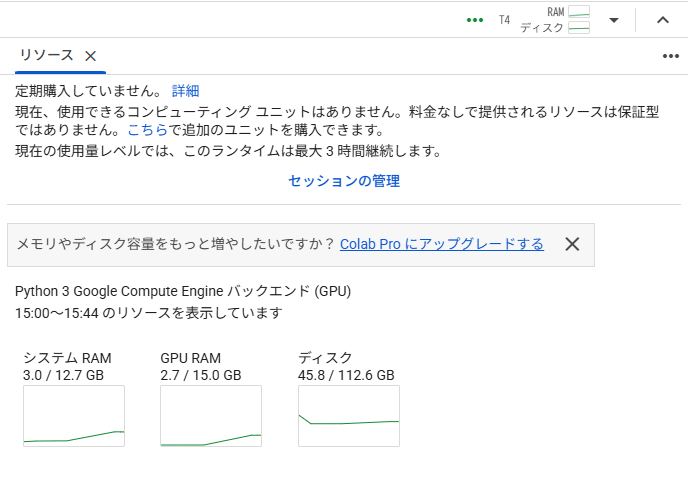

「コンピューティングユニット」の残数はGoogle Colab右上の「RAM」「ディスク」の隣の三角形から、「リソース」を選択すると確認できます。

無料版ではGPUを利用できる時間に限りがあります。これはコンピューティングユニットとは違い、明記されていません。また、有料版のユーザーが優先的に利用できる仕様のため、使ってるうちにセッションを接続されてしまうこともあります。詳しくはGoogle Colabのサポート情報を確認してください。

無料版の上限に達すると、しばらくGPUを利用できなくなります。どれぐらい待てばまた利用可能になるのかも明記されていないため、有料版を購入したほうが快適に利用できるのは間違いありません。

Google Colaboratory よくある質問(外部サイト)

導入は以上になります。

利用方法

準備ができたら画像生成をしてみましょう。

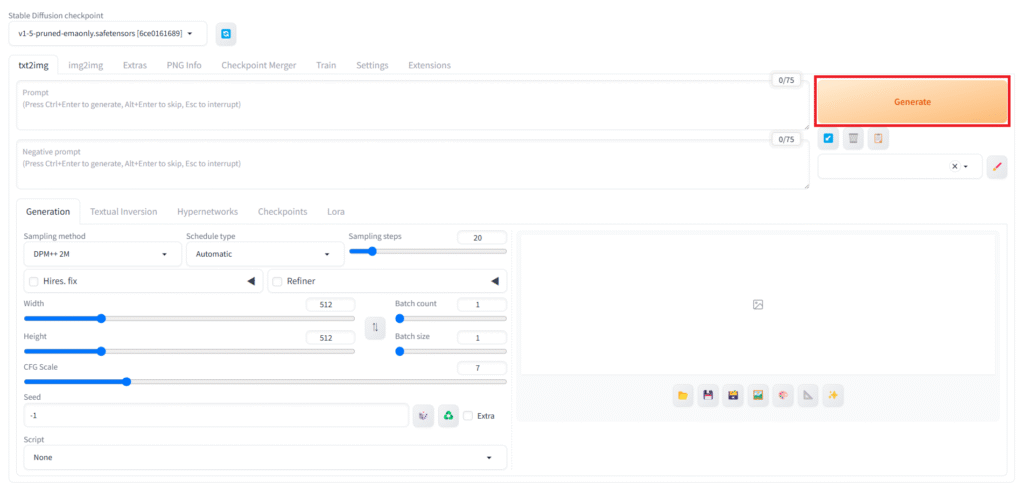

その前に、AUTOMATIC1111には様々な機能が備わっています。今回は「とにかく画像生成をする」という点に絞って解説します。

なので、最初は思ったような画像が生成できないかもしれません。これは誰が悪いという訳ではなく、「AIの全力を引き出し切れていない」ということです。デフォルトで使えるモデルデータは特化した強みがなく、実写風でもアニメ風でも中途半端なものになりがちです。今回はGoogle colabの無料版という前提で話しますが、ここに由来する問題もあります。

また、UIは日本語化することもできますが、多くの解説記事などは英語UIを前提に解説しているところが多いため、翻訳するとかえって調べるときに不便になる可能性があります。Google Colabでは起動するたびに初期設定に戻ってしまうので、英語UIに慣れておきましょう。

まずは「画像生成できた」という体験だけ味わっていただければと思います。より詳しい解説は改めて行う予定ですので、ぜひチェックしてください。

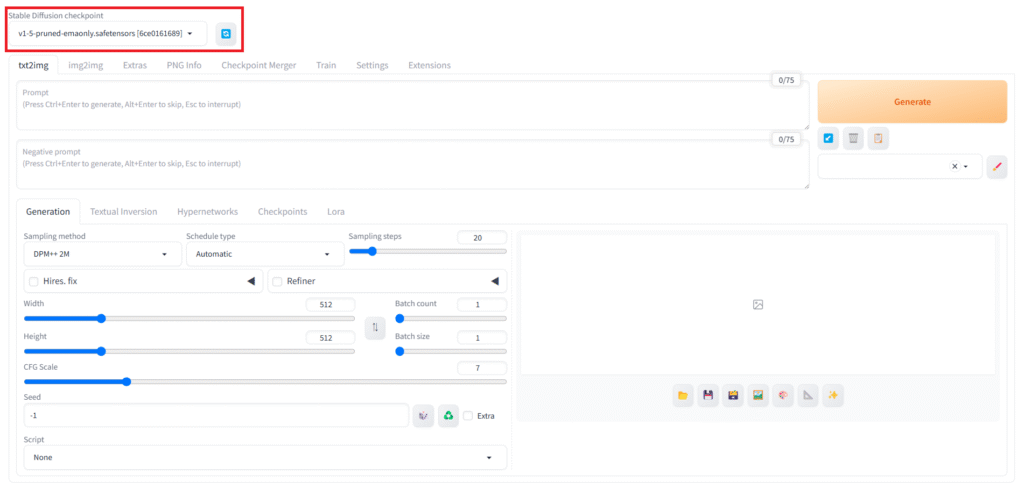

「Stable Diffusion checkpoint」

ここが「チェックポイント」と呼ばれるモデルデータを選択する欄です。もしアップロードしたモデルが表示されない場合は、右側の青いアイコンをクリックすると再読み込みされて、表示されるようになります。

もしモデルデータを持っている場合はGoogle Colabのページに行き、左側のフォルダアイコンをクリックし、「stable-diffusion-webui\models\stable-diffusion」内にアップロードすることで使用できるようになります。

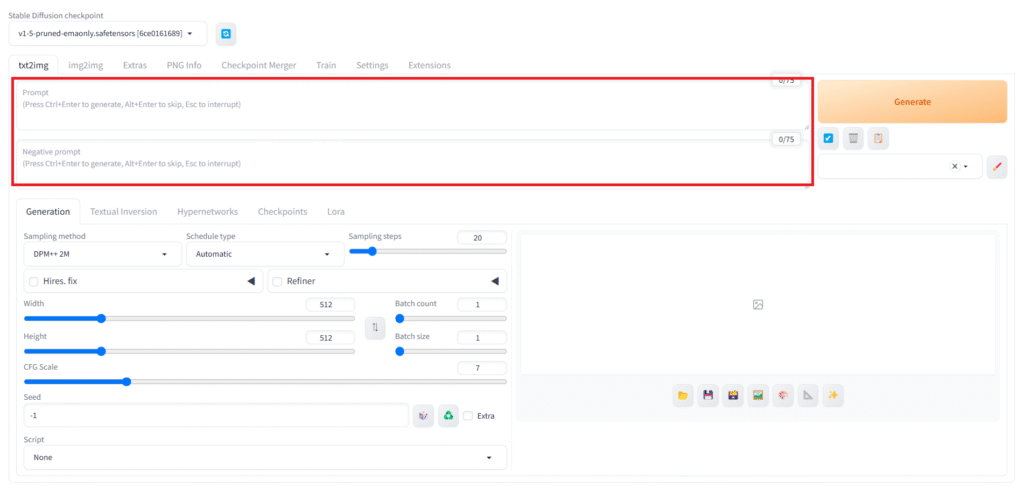

「prompt(プロンプト)」「negative prompt(ネガティブプロンプト)」

まずは「プロンプト」と「ネガティブプロンプト」を入力する欄になります。

プロンプトの入力方法については、過去の記事で解説していますので、そちらも併せてご確認ください。

画像生成はこの「プロンプト」が最重要と言えます。どんなに設定を整えても、プロンプトがいい加減だと思ったようなものを生成することはできません。(それをあえてガチャのように楽しむのも一つの手です。)

上の欄には出力してほしいものを、下の欄には出力してほしくない物を入力します。

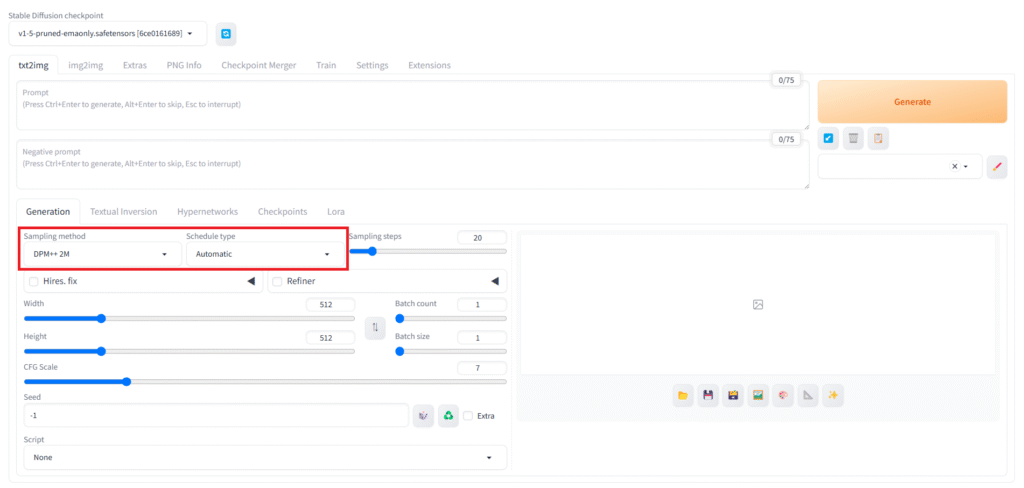

「Sampling method」「Schedule type」

これは最初に説明した「拡散モデル」がノイズの集合から、どのように画像を生成するかの方法と手順の設定になります。

「Sampling method」

画像からノイズ除去をするための計算方法の種類です。それぞれ計算速度や得意な画風が異なります。掃除で例えるなら、モップなのか、掃除機なのか、ほうきなのかを選ぶイメージです。

「Schedule type」

ノイズ除去の進め方(ペース配分)です。「Sampling method」との組み合わせで画像の仕上がりが変わります。掃除で例えるなら、最初に一気にやるのか、後でまとめてやるのか、一定のペースを保ってやるのかを選ぶイメージです。

と言っても全然ピンと来ないとおもいますので、とりあえずは以下の設定がおすすめです

1.Sampling method:「DPM++ 2M」 Schedule type:「Karras」

2.Sampling method:「Euler A」 Schedule type:「automatic」

「karras」は「DPM++」系と相性がいいです。なめらかな画像生成ができます。「Euler A」も多くのモデルで推奨されています。Schedule typeの影響を受けにくいので、automaticで問題ないです。

使用するモデルによっては、推奨設定が存在する場合がありますので、これに従いましょう。

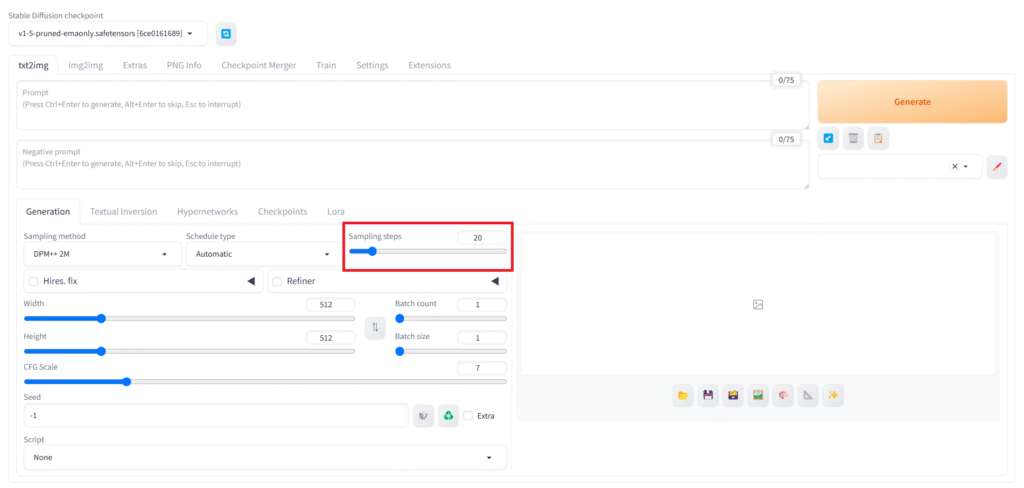

「Sampling steps」

画像生成するにあたって、何回ノイズ除去を行うかの設定です。下げれば下げるほどノイズまみれのまま生成されるようになり、上げれば上げるほどきれいになる…というわけでもなく、一定以上の数値にしても、ある程度の品質以上にはならないため、処理時間やGPUにかかる負荷が増すだけになります。

おすすめは20~30程です。これもモデルデータによっては推奨設定がある場合があります。

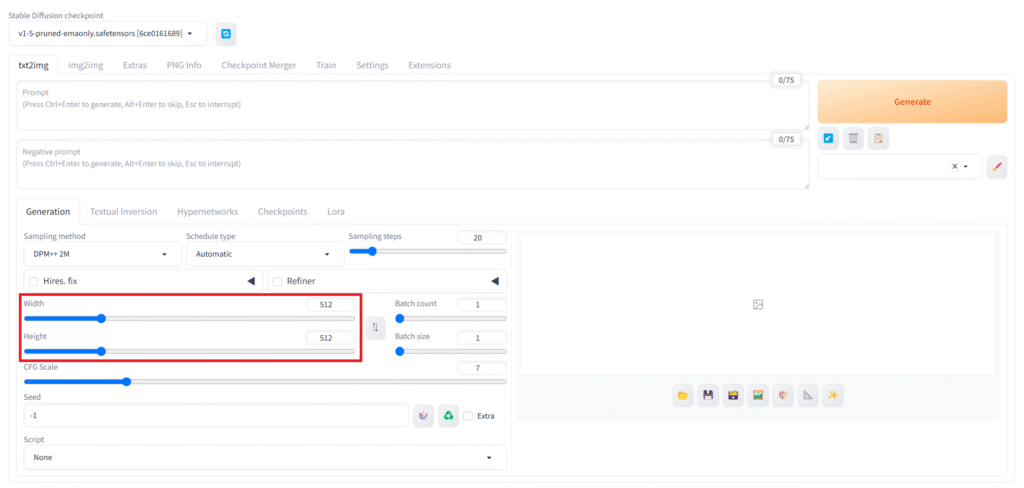

「width」「height」

生成する画像のサイズを設定できます。

自由に設定できますが、モデルや、描きたい構図によって適したサイズが指定されていることもあります。

例えば、「立っている人の全身が映った画像」であれば縦長が適しており、横長にすると背景に余計なものが描かれてしまう可能性が高くなります。このように生成したい構図に合わせて比率を選択する必要があります。

また、デフォルトのモデルである「v1-5-pruned-emaonly」は「SD 1.5」系という古い規格のモデルであるため、512*512がサポートされており、解像度を高くすると破綻を起こしてしまう確率も高くなります。

逆に、現在メジャーに扱われている「SDXL」系や最新の「SD 3」系のモデルでは1024*1024を基本として学習しているため、512*512では破綻が大きくなる傾向にあります。

「T4 GPU」では1024*1024のレベルの解像度で生成するだけのVRAMを確保できないので、自然と「SDXL」系や「SD 3」系のモデルを使用するのは困難です。

機能として、数字は自由に入力できるようにはなっていますが、基本的には「8の倍数」に設定しておくのが安心です。これには多くのモデルが画像を効率的に学習するための手法が関わっています。

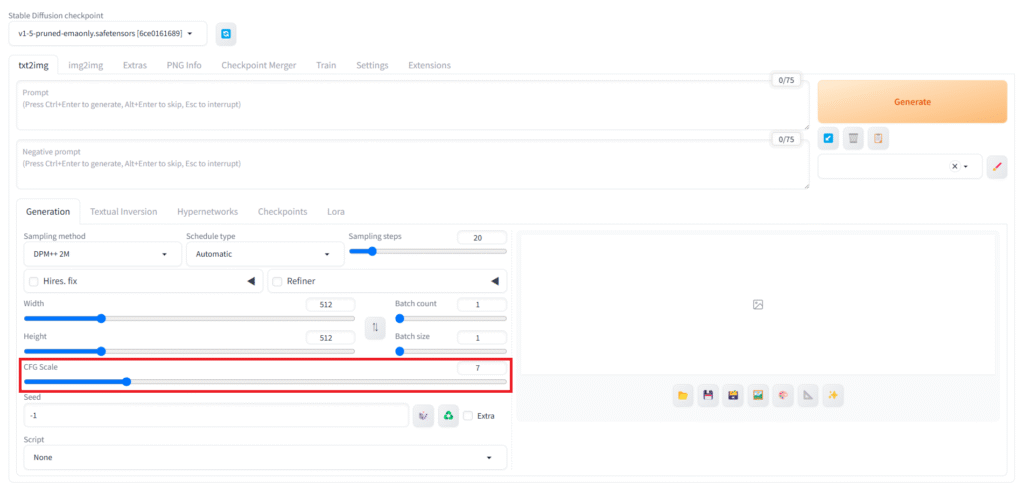

「CFG Scale」

プロンプトにどれだけ忠実に従うかを設定できます。

低ければ生成画像の幅が広がり、高ければよりプロンプトの影響を強く受ける分、破綻しやすくなります。最初はデフォルトの7で試し、プロンプトの指示が弱いと感じたら少し上げ、画像が破綻するようなら少し下げてみましょう。モデルによっては推奨設定があることもあります。

CFGをどんなに上げてもプロンプトが反映されない時は、単純に誤字がある、モデルデータの学習元に、プロンプトが示すものが十分含まれていないといった原因がある可能性が高いです。

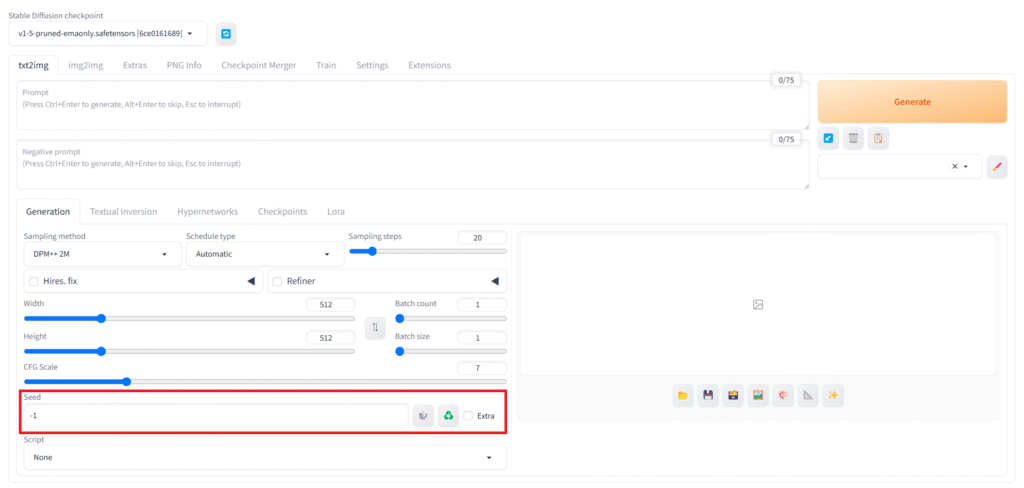

「Seed」

Seed値は生成のたびにランダムな結果を表示させるための機能です。

デフォルトでは「-1」が入力されており、これは生成のたびにランダムなSeed値が割り当てられるということを意味しています。

任意の数字を入力することで、そのSeed値に固定することができます。数字自体に意味はないので、適当に決めて大丈夫です。

隣にあるサイコロアイコンをクリックすると、-1に設定しなおすことができます。

緑の矢印アイコンをクリックすると、最後に生成した画像のSeed値を取得できます。

Seed値を固定すると、同じような結果が出やすくなります。「気に入ったけど少しだけ変えたい」という時には、その画像と同じSeed値を使用し、微調整するといった使い方ができます。

Seed値を含めて、全く同じ設定にすれば全く同じ画像を出力することができます。

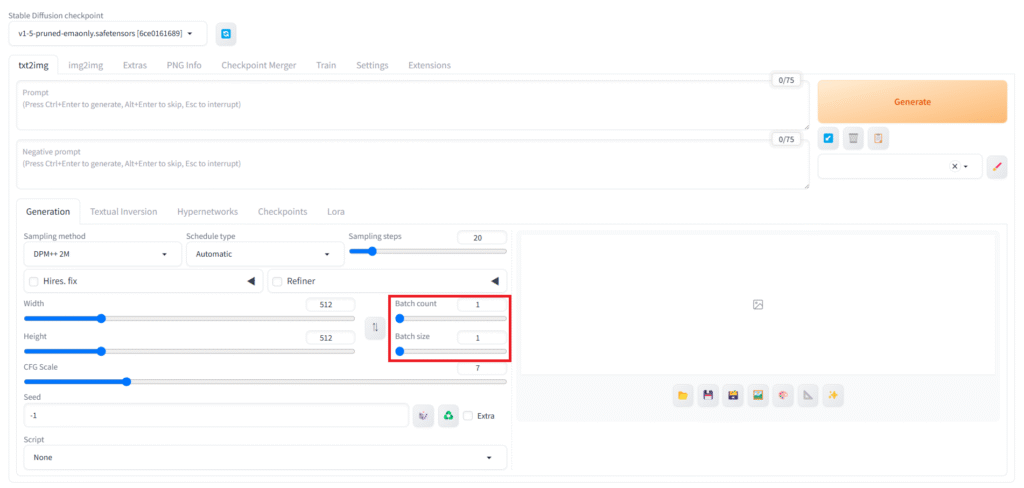

「Batch count」「Batch size」

「Batch count」は何回連続で生成するかの設定です。例えば10に設定すれば、10枚をSeed値以外は同じ設定で次々と生成するので、その間に別の作業をすることもできます。

「Batch size」は何枚同時に生成するかの設定です。こちらは同時に処理が進むため、増やすとハイスペックGPUでなければ動作が重くなったり、エラーが出てしまう可能性があります。もし使っているGPUの性能が十分に高いのであれば、「Batch count」と合わせて効率よく大量に生成することができます。

ここまで設定出来たら、最後に右上の「Generate」をクリックして生成開始です。下の欄に生成された画像が表示されます。

これまでの解説のまとめ表です。

| パラメータ名 | 推奨設定 | 機能 |

|---|---|---|

| Sampling method | DPM++ 2M Euler A | ノイズ除去の計算方法。速度や得意な画風が異なる |

| Schedule type | Karras automatic | ノイズ除去の進め方。Sampling methodとの組み合わせで仕上がりが変わる |

| Sampling steps | 20~30 | ノイズ除去の回数。少ないとノイズが残りやすく、多すぎても品質向上は限定的で処理時間が増加 |

| Width / Height | 512*512 (SD1.5系) | 生成画像のサイズ。8の倍数が推奨。モデルにより適切な基本サイズがある(SDXL系は1024*1024) |

| CFG Scale | 7 (デフォルト) | プロンプトへの忠実度。低いと自由度が増し、高いと忠実になるが破綻しやすくなる |

| Seed | -1 (ランダム) | 生成結果のランダム性を制御。固定すると類似画像を生成しやすくなる |

| Batch count | 1~ | 連続生成回数 |

| Batch size | 1~ | 同時生成枚数。増やすとGPU負荷が高まる |

注意!

繰り返しにはなりますが、Google Colabではランタイムの接続を解除するたびに生成した画像もすべて消えてしまいます。気に入った画像は都度ローカルに保存するようにしましょう。

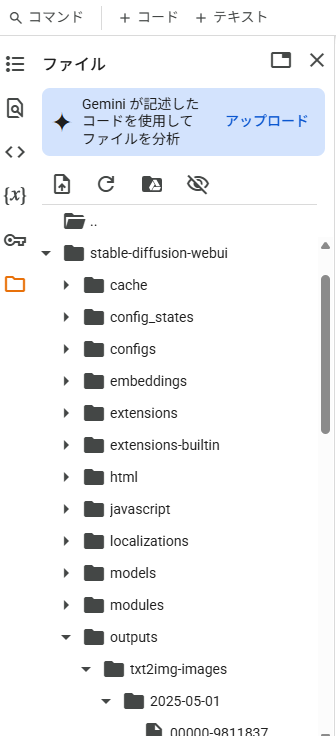

Google Colabのページに戻り、画面左端にあるフォルダアイコンをクリック。

「stable-diffusion-webui\outputs\txt2img-images\日付」に生成した画像が格納されています。

あるいは、生成された画像を右クリックして「名前を付けて保存」したり、画像下に並んでるアイコンのうち、左側のフォルダアイコンやフロッピーディスクアイコンから保存しましょう。(フロッピーディスクを知らない人は調べてね!)

使い終わったら「ランタイムを接続解除して削除」をしましょう。この時点でアップロードしたすべてのデータや生成した画像が消えてしまいますが、接続を解除しないとコンピューティングユニットが消費され続けるので、無駄遣いを避けるために可能な限りまとめて作業して、終わったら消すを心がけましょう。

画像生成するための基本的な機能や設定の紹介は以上になります。

最後に

今回はStable Diffusionを利用するための1つの手段としてGoogle Colabを利用した「AUTOMATIC1111」の導入・利用方法をご紹介をしてきました。

Google Colab以外にも、GPUクラウドサービスは多く存在します。Google Colabとは違い、自分でPythonを導入するところから始めなければならないところもありますし、料金形態も様々です。

我々は今後も安心して利用できるサービスについて紹介していきます。

Stable Diffusion(AUTOMATIC1111)で生成した画像は多くの場合商用利用が可能ですが、AIによる画像生成は意図せず第三者の著作権・肖像権・商標権などを侵害するリスクもあります。また、モデルデータや追加学習データによっては商用利用を禁止していたり、商用利用以外でも公開の際にクレジット表記が求められる場合もありますので、公開・商用利用の際は、各モデルの利用規約や関連する法律を必ず確認してください。

最後にデフォルトで備わってるモデル「v1-5-pruned-emaonly」で何枚か画像生成をしてみましょう。

プロンプト

masterpiece, best quality, high quality, (animeとphotographicの2パターン試しました), 1girl, blue hair, wavy hair, medium hair, green eyes

ネガティブプロンプト

worst, bad, error, missing, extra

正直、微妙なクオリティです。きっと皆さんがよく目にするようなAIイラストのイメージには遠く及びません。プロンプトの効きも悪く、目や手に異常なまでの破綻が起こっています。これはモデルが学習したデータの質が低いためです。

高品質なモデルデータを使えば、同じプロンプトでも出来上がるイラストのクオリティの差は歴然です。

アニメ風、実写風でそれぞれに特化した別のモデルを使用しています。

こういったモデルの多くは「Civitai」というサイトでダウンロードできます。各モデルのダウンロードページに推奨設定や、商業利用などのライセンス表記が載っています。

モデル・LoRAデータの導入方法は以下の記事も併せてご確認ください。

その他の拡張機能の導入方法、利用方法などは別途まとめた記事を公開予定ですので、ぜひチェックしてください。

【関連記事】

ウェールズの研究者が、ジャガイモ疫病と戦うためのAIアプリ「DeepDetectプロジェクト」を開発している。

ジャガイモ疫病は世界のジャガイモ作物の約20%の損失を引き起こし、総額45億ドル以上の経済的損失をもたらしている。この病気はPhytophthora infestans(フィトフトラ・インフェスタンス)という病原体によって引き起こされる。

従来の検査は労働集約的で費用がかかり、ヒューマンエラーが発生しやすいため、見逃された場合は病気が畑全体に広がる可能性がある。新しいAIアプリはスマートフォンのカメラを使用してジャガイモの葉の変化を検出し、農家が通常現れる前に病気の兆候を察知できるようにする。

ウェールズでは17,000ヘクタール以上がジャガイモ栽培に充てられているとされる。研究者は農家からの直接的なフィードバックを収集中で、早期診断により農家がより迅速に病気と戦えるようになることを期待している。この技術は将来的にジャガイモを超えて農業産業の他分野にも拡張される可能性がある。

From: ![]() Researchers Want To Use AI To Fight Potato Blight

Researchers Want To Use AI To Fight Potato Blight

【編集部解説】

このニュースが注目すべき理由は、農業分野におけるAI活用の新たな地平を示している点にあります。特に食料安全保障の観点から、ジャガイモ疫病という世界的な課題に対する革新的なアプローチが提示されています。

従来の農業では、病気の検出は人間の目視に頼る部分が大きく、症状が目に見えるようになった時点では既に手遅れになることが多々ありました。Phytophthora infestans(フィトフトラ・インフェスタンス)という病原体によるジャガイモ疫病は、1845年のアイルランド大飢饉の原因ともなった歴史的な脅威であり、現在でも湿度の高い条件下では数週間で作物を全滅させる可能性があります。

アベリストウィス大学のDeepDetectプロジェクトは、コンピュータビジョンと機械学習を組み合わせて、スマートフォンのカメラを通じてジャガイモの葉の微細な変化を検出し、人間の目では見えない初期段階での病気の兆候を捉えることを目指しています。この技術の革新性は、従来の広域予防散布からtargeted intervention(標的介入)へのパラダイムシフトにあります。

ある報告によると、ウェールズの農家は予防的な殺菌剤散布に年間500万ポンド以上を費やしていると推定されています。このAIシステムが実現すれば、必要な場所にのみピンポイントで対策を講じることが可能になり、大幅なコスト削減と環境負荷軽減が期待できます。

技術面では、このシステムがリアルタイム位置情報と組み合わされることで、location-specific disease diagnoses(場所特有の病気診断)を提供できる点が重要です。これにより、農家は自分の畑の特定の区画に対して即座に対応できるようになります。

興味深いのは、開発チームが最初から農家との共同設計アプローチを採用していることです。これにより、技術的に優れていても実用性に欠けるという、多くの農業技術製品が陥りがちな問題を回避しようとしています。

将来的な展望として、この技術は他の作物や病害にも応用可能とされており、農業分野におけるpredictive analytics(予測分析)の基盤技術となる可能性があります。特に気候変動により病害の発生パターンが変化する中で、このような早期警告システムの重要性はますます高まるでしょう。

一方で、農家のデジタルリテラシーや通信インフラの整備状況、データプライバシーの問題など、実装に向けた課題も存在します。また、AIの判断精度やfalse positive(偽陽性)・false negative(偽陰性)のリスクについても、実用化に向けて慎重な検証が必要です。

この研究はウェールズ政府のSmart Flexible Innovation Support(SFIS)プログラムの支援を受けており、政府レベルでも農業のデジタル変革が重要政策として位置づけられていることがわかります。世界人口の増加と気候変動という二重の課題に直面する現代において、このような技術革新は単なる効率化を超えた、人類の生存戦略としての意味を持っています。

【用語解説】

potato blight(ジャガイモ疫病)

Phytophthora infestansという病原体によって引き起こされるジャガイモの致命的な病気である。感染した植物から数日で広大な畑を全滅させる能力を持ち、1845年のアイルランド大飢饉の原因ともなった歴史的な脅威である。

machine learning(機械学習)

データから自動的にパターンを学習し、予測や分類を行うAI技術である。農業分野では作物の病気検出や収穫量予測などに活用されている。

targeted intervention(標的介入)

特定の問題が発生している場所にのみピンポイントで対策を講じるアプローチである。従来の広域予防散布と対比される効率的な手法である。

【参考リンク】

Aberystwyth University(アベリストウィス大学)(外部)

ウェールズにある公立大学で、今回のDeepDetectプロジェクトを主導している。農業科学や環境科学の分野で高い評価を受けている。

Welsh Government(ウェールズ政府)(外部)

イギリスの構成国の一つであるウェールズの地方政府。Smart Flexible Innovation Supportプログラムを通じて農業技術革新を支援している。

【参考動画】

【参考記事】

Farming’s new weapon: AI app to spot potato blight before it hits(外部)

ウェールズの科学者が開発中のDeepDetectプロジェクトについて詳しく報じた記事。予防散布に年間527万ポンドを費やしているウェールズの現状や具体的な情報を提供している。

Potato blight warning app to use AI to help farmers – BBC News(外部)

BBCによるDeepDetectプロジェクトの報道。ジャガイモが世界で4番目に重要な主食作物であることや食料安全保障の観点からこの技術の重要性を説明している。

Agriculture Technology News 2025: New Tech & AI Advances(外部)

2025年の農業技術トレンドについて包括的に分析した記事。世界の農場の60%以上がAI駆動の精密農業技術を採用すると予測している。

Phytophthora infestans: An Overview of Methods and Attempts(外部)

Phytophthora infestansの科学的研究論文。病原体の遺伝子構造や高い変異率について詳細な説明を提供している。

【編集部後記】

農業とAIの融合は、私たちの食卓の未来を大きく変える可能性を秘めています。スマートフォンひとつで作物の病気を早期発見できる時代が目前に迫っている今、皆さんはどんな農業の未来を想像されますか?

食料安全保障という人類共通の課題に対して、テクノロジーがどこまで貢献できるのか、一緒に考えてみませんか?また、このような技術が実用化された際、消費者である私たちの生活にはどのような変化が訪れると思われますか?ぜひSNSで皆さんの率直なご意見をお聞かせください。

法執行技術企業Axon社が開発したAIソフトウェア「Draft One(ドラフト・ワン)」が全米の警察署で導入されている。

このツールは警察官のボディカメラの音声認識を基に報告書を自動作成するもので、Axon社の最も急成長している製品の一つである。コロラド州フォートコリンズでは報告書作成時間が従来の1時間から約10分に短縮された。Axon社は作成時間を70%削減できると主張している。

一方で市民権団体や法律専門家は懸念を表明しており、ACLU(米国市民自由連合)は警察機関にこの技術から距離を置くよう求めている。ワシントン州のある検察庁はAI入力を受けた警察報告書の受け入れを拒否し、ユタ州はAI関与時の開示義務を法制化した。元のAI草稿が保存されないため透明性や正確性の検証が困難になるという指摘もある。

From: ![]() Cops Are Using AI To Help Them Write Up Reports Faster

Cops Are Using AI To Help Them Write Up Reports Faster

【編集部解説】

このニュースで紹介されているAxon社のDraft Oneは、単なる効率化ツールを超えた重要な議論を巻き起こしています。

まず技術的な側面を整理しておきましょう。Draft Oneは、警察官のボディカメラ映像から音声を抽出し、OpenAIのChatGPTをベースにした生成AIが報告書の下書きを作成するシステムです。Axon社によると、警察官は勤務時間の最大40%を報告書作成に費やしており、この技術により70%の時間を削減できると主張しています。

しかし、実際の効果については異なる報告が出ています。アンカレッジ警察署で2024年に実施された3ヶ月間の試験運用では、期待されたほどの大幅な時間短縮効果は確認されませんでした。同警察署のジーナ・ブリントン副署長は「警察官に大幅な時間短縮をもたらすことを期待していたが、そうした効果は見られなかった」と述べています。審査に要する時間が、報告書生成で節約される時間を相殺してしまうためです。

このケースは単独のものではありません。2024年にJournal of Experimental Criminologyに発表された学術研究でも、Draft Oneを含むAI支援報告書作成システムが実際の時間短縮効果を示さなかったという結果が報告されています。これらの事実は、Axon社の主張と実際の効果に重要な乖離があることを示しています。

最も重要な問題は透明性の欠如です。Draft Oneは、意図的に元のAI生成草案を保存しない設計になっています。この設計により、最終的な報告書のどの部分がAIによって生成され、どの部分が警察官によって編集されたかを判別することが不可能になっています。

この透明性の問題に対応するため、カリフォルニア州議会では現在、ジェシー・アレギン州上院議員(民主党、バークレー選出)が提出したSB 524法案を審議中です。この法案は、AI使用時の開示義務と元草案の保存を義務付けるもので、現在のDraft Oneの設計では対応できません。

法的影響も深刻です。ワシントン州キング郡の検察庁は既にAI支援で作成された報告書の受け入れを拒否する方針を表明しており、Electronic Frontier Foundation(EFF)の調査では、一部の警察署ではAI使用の開示すら行わず、Draft Oneで作成された報告書を特定することができないケースも確認されています。

技術的課題として、音声認識の精度問題があります。方言やアクセント、非言語的コミュニケーション(うなずきなど)が正確に反映されない可能性があり、これらの誤認識が重大な法的結果を招く可能性があります。ブリントン副署長も「警察官が見たが口に出さなかったことは、ボディカメラが認識できない」という問題を指摘しています。

一方で、人手不足に悩む警察組織にとっては魅力的なソリューションです。国際警察署長協会(IACP)の2024年調査では、全米の警察機関が認可定員の平均約91%で運営されており、約10%の人員不足状況にあることが報告されています。効率化への需要は確実に存在します。

しかし、ACLU(米国市民自由連合)が指摘するように、警察報告書の手書き作成プロセスには重要な意味があります。警察官が自らの行動を文字にする過程で、法的権限の限界を再認識し、上司による監督も可能になるという側面です。AI化により、この重要な内省プロセスが失われる懸念があります。

長期的な視点では、この技術は刑事司法制度の根幹に関わる変化をもたらす可能性があります。現在は軽微な事件での試験運用に留まっているケースが多いものの、技術の成熟と普及により、重大事件でも使用されるようになれば、司法制度全体への影響は計り知れません。

【用語解説】

Draft One(ドラフト・ワン):

Axon社が開発したAI技術を使った警察報告書作成支援ソフトウェア。警察官のボディカメラの音声を自動認識し、OpenAIのChatGPTベースの生成AIが報告書の下書きを数秒で作成する。警察官は下書きを確認・編集してから正式に提出する仕組みである。

ACLU(American Civil Liberties Union、米国市民自由連合):

1920年に設立されたアメリカの市民権擁護団体。憲法修正第1条で保障された言論の自由、報道の自由、集会の自由などの市民的自由を守る活動を行っている。現在のDraft Oneに関する問題について警告を発している。

Electronic Frontier Foundation(EFF):

デジタル時代における市民の権利を守るために1990年に設立された非営利団体。プライバシー、言論の自由、イノベーションを擁護する活動を行っている。Draft Oneの透明性問題について調査・批判を行っている。

IACP(International Association of Chiefs of Police、国際警察署長協会):

1893年に設立された世界最大の警察指導者組織。法執行機関の専門性向上と公共安全の改善を目的として活動している。全米の警察人員不足に関する調査を実施している。

【参考リンク】

Axon公式サイト(外部)

Draft Oneの開発・販売元でProtect Lifeをミッションに掲げる法執行技術企業

Draft One製品ページ(外部)

生成AIとボディカメラ音声で数秒で報告書草稿を作成するシステムの詳細

ACLU公式見解(外部)

AI生成警察報告書の透明性とバイアスの懸念について詳細に説明した白書

EFF調査記事(外部)

Draft Oneが透明性を阻害するよう設計されている問題を詳細に分析

国際警察署長協会(外部)

全米警察機関の人員不足状況と採用・定着に関する2024年調査結果を公開

【参考記事】

アンカレッジ警察のAI報告書検証 – EFF(外部)

3ヶ月試験運用で期待された時間短縮効果が確認されなかった結果を詳述

AI報告書作成の効果検証論文 – Springer(外部)

Journal of Experimental CriminologyでAI支援システムの時間短縮効果を否定

警察署でのAI活用状況 – CNN(外部)

コロラド州フォートコリンズでの事例とAxon社の70%時間短縮主張を報告

全米警察人員不足調査 – IACP(外部)

1,158機関が回答し平均91%の充足率で約10%の人員不足状況を報告

カリフォルニア州AI開示法案 – California Globe(外部)

SB 524法案でAI使用時の開示義務と元草稿保存を義務付ける内容を詳述

ACLU白書について – Engadget(外部)

フレズノ警察署での軽犯罪報告書限定の試験運用について報告

アンカレッジ警察の導入見送り – Alaska Public Media(外部)

副署長による音声のみ依存で視覚的情報が欠落する問題の具体的説明

【編集部後記】

このDraft Oneの事例は、私たちの身近にある「効率化」という言葉の裏に隠れた重要な問題を浮き彫りにしています。特に注目すべきは、Axon社が主張する効果と実際の現場での検証結果に乖離があることです。

日本でも警察のDX化が進む中、同様の技術導入は時間の問題かもしれません。皆さんは、自分が関わる可能性のある法的手続きで、AIが作成した書類をどこまで信頼できるでしょうか。また、効率性と透明性のバランスをどう取るべきだと思いますか。

アンカレッジ警察署の事例のように、実際に試してみなければ分からない課題もあります。ぜひSNSで、この技術に対する率直なご意見をお聞かせください。私たちも読者の皆さんと一緒に、テクノロジーが人間社会に与える影響について考え続けていきたいと思います。

AI(人工知能)ニュース

Anthropic Claude Sonnet 4、100万トークンのコンテキスト対応でソフトウェアプロジェクト全体の一括解析が可能に

Published

7か月 agoon

2025年8月13日By

TaTsu

2025年8月12日、AnthropicはClaude Sonnet 4が1リクエストで最大100万トークンを処理可能になったと発表した。

Public BetaとしてAnthropicのAPIとAmazon Bedrockで提供し、Google CloudのVertex AI対応は予定中である。75,000行超のコードベース解析が可能となり、内部テスト「needle in a haystack」で100%の正確性を達成した。

価格は入力200Kトークン以下が$3/M、出力が$15/M、超過分は入力$6/M、出力$22.5/Mとなる。Menlo Venturesの調査ではAIコード生成市場でAnthropicは42%、OpenAIは21%のシェアを持つ。主要顧客はCursorとGitHub Copilotで、年間収益ランレート50億ドルのうち約12億ドルを占める。初期利用はTier 4やカスタムレート制限のAPI顧客、Fortune 500企業などである。

From: ![]() Claude can now process entire software projects in single request, Anthropic says

Claude can now process entire software projects in single request, Anthropic says

【編集部解説】

AnthropicがClaude Sonnet 4に最大100万トークンのコンテキスト(文脈)処理を開放しました。単一リクエストで約75,000行のコードや約75万語のドキュメントを一気に読み込める規模で、APIおよびAmazon Bedrock経由のPublic Betaとして段階的に展開されています。これにより、これまで分割前提だった大規模リポジトリや多数文書の横断的な関連把握が、1回の入出力で可能になります。

技術的には、長文脈での「needle in a haystack(干し草の山の中の針)」的検索・想起の正確性が論点です。Anthropicは内部評価で100%の再現性を謳いますが、これはあくまで社内テストであり、実運用におけるコード異臭検知や設計上のトレードオフ把握など、多層的な推論の持続性は現場検証が不可欠です。ただし、プロジェクト全体像を”丸ごと”見渡せること自体は、ファイル粒度の分割では失われがちだった依存関係と設計意図を保ったまま提案できる余地を広げます。

実装・料金面では、200Kトークン以下は従来の$3/MTok(入力)・$15/MTok(出力)に据え置き、200K超から$6/MTok・$22.50/MTokへ切り替わる二段制です。長文脈のβ利用は当面Tier 4およびカスタム制限の組織が対象で、プロンプトキャッシング(prompt caching(プロンプトの再利用キャッシュ))と併用することでリピート照会型ワークロードの総コストを抑制できる設計です。この「キャッシュ×長文脈」によるRAG代替のコスト・品質最適化は、法務・金融・製造のナレッジ資産を持つ企業にとって実践的な選択肢になり得ます。

市場文脈では、コード生成が企業導入の主用途として伸び、Menlo Ventures調査でAnthropicのコード生成シェアは42%、OpenAIは21%とされています。企業は価格より性能を優先し、より高性能モデルへの素早いアップグレードが常態化しています。一方で、価格攻勢を強める競合(例:GPT-5)や、プラットフォーム戦略におけるアライアンスの力学は、モデル採用の流動性を高める要因となります。

できるようになることは明確です。第一に、リポジトリ全体の設計レビュー、リファクタリング計画、仕様と実装の整合性監査を「文脈を保ったまま」一気通貫で回せます。第二に、数百ファイル規模の文書群からの合意形成資料やリスク論点の抽出など、関係性を前提とする要約・統合がしやすくなります。第三に、ツール呼び出しを跨いだエージェント運用で、長いワークフローの一貫性と再現性を保ちやすくなります。

留意すべきリスクもあります。長文脈は「見えすぎるがゆえの錯覚」を生みやすく、誤った前提の連鎖や過剰一般化が交じると、広範囲に影響する提案ミスになり得ます。加えて、過去バージョンで観測された望ましくない振る舞いの教訓から、安全性設計は今後も注視が必要です。ベータ段階では、重要判断におけるヒューマン・イン・ザ・ループを厳格に保つべきです。

規制・ガバナンス面では、長文脈化に伴い入力データの守備範囲が拡大します。権限分離、機密区分、データ最小化の実装が不十分だと、不要な個人情報・営業秘密まで取り込むリスクが増します。監査可能性(誰が・いつ・何を入力し、どの判断がなされたか)を担保するためのログ設計や、キャッシュのTTL・アクセス制御は、モデル選定と同列の経営課題です。

長期的には、RAG前処理中心の「情報を選んでから渡す」設計から、長文脈を前提に「まず全体を見せ、モデル自身に選ばせる」設計への再編が進みます。これは、情報アーキテクチャとMLOpsの分業を再定義し、エージェント編成・権限設計・コスト会計の枠組みまで影響を与えます。GeminiやOpenAIも大規模コンテキストの路線にあり、長文脈×価格×推論性能の三つ巴は当面の焦点であり続けるでしょう。

最後に、なぜ今か。モデル性能の頭打ち議論が出る中で、「入力側の律速」を外すことは実務価値に直結します。プロダクトロードマップ、設計思想、運用手順、テスト資産、ナレッジの「全体」を理解したうえで提案できるAIは、開発現場の意思決定速度と品質を底上げします。長文脈は魔法ではありませんが、現場の「分割に伴う損失」を削る現実的なテコになります。

【用語解説】

コンテキストウィンドウ(context window)

モデルが一度のリクエストで保持・参照できる入力の範囲のこと。

トークン(token)

テキストを分割した最小単位で、課金やモデルの処理量の基準となる。

needle in a haystack(干し草の山の中の針)

大量テキスト中の特定情報を探索する内部評価手法の通称。

Public Beta(公開ベータ)

一般開放された試験提供段階で、正式版前の段階を指す。

プロンプトキャッシング(prompt caching)

繰り返し使う大規模プロンプトをキャッシュして遅延とコストを削減する仕組み。

RAG(Retrieval-Augmented Generation)

検索・取得結果を補助情報として生成に用いる方式。

リポジトリ横断コード解析

リポジトリ全体を読み込み、依存関係や設計をまたいで解析・提案すること。

コンテキスト対応エージェント

長いワークフローや多数のツール呼び出しにわたり文脈を保持するAIエージェント。

【参考リンク】

Anthropic(外部)

人工知能モデルClaudeを提供する企業で、Sonnet 4の1Mトークン文脈を発表している。

Claude Sonnet 4: 1Mトークン対応発表(外部)

Sonnet 4の1Mトークン対応、ユースケース、価格調整、提供範囲を案内する発表ページである。

Anthropic API Pricing(外部)

Sonnet 4の長文脈価格やティア条件、バッチ割引、キャッシュ適用などの詳細を示す。

Amazon Bedrock(外部)

複数基盤モデルを提供するAWSの生成AIサービスで、Claudeの提供も含む。

Google Cloud Vertex AI(外部)

Google CloudのAIプラットフォームで、基盤モデルの提供と統合機能を持つ。

【参考動画】

【参考記事】

Claude Sonnet 4 now supports 1M tokens of context(外部)

Sonnet 4が最大1Mトークンの文脈に対応し、リポジトリ全体の解析、文書群統合、コンテキスト対応エージェントなどのユースケースが拡張された。

Anthropic’s Claude AI model can now handle longer prompts(外部)

Sonnet 4が1Mトークンに対応し、約750,000語または75,000行規模の入力が可能になった。

Menlo Ventures – 2025 Mid-Year LLM Market Update(外部)

企業LLM市場のシェア変動、API支出の倍増、コード生成の台頭、Anthropicのコード生成シェア42%などを提示。

Techmeme summary: Anthropic updates Claude Sonnet 4(外部)

1Mトークンの文脈対応、約750K語/75K行、5倍拡張という要点を集約し、同日の報道の中心情報を短く示す。

Simon Willison: Claude Sonnet 4 now supports 1M tokens of context(外部)200Kと1Mでの二段価格、βヘッダー指定、Tier 4制限など、実装上の具体的留意点を補足し、他社(Gemini)の価格比較も紹介。

【編集部後記】

みなさんは、開発しているサービスやプロジェクトの全体像を、AIが一度に理解して提案してくれるとしたら、どんな活用を思い描きますか。75,000行のコードベースを分割せずに扱えることは、単なる効率化を超えた可能性を秘めています。

これまで、大規模なシステムの改善提案を得るためには、開発者が手作業でコードを分割し、重要な文脈を失うリスクを抱えながら作業していました。しかし今回のClaude Sonnet 4の長文脈対応により、プロジェクト全体の設計思想や依存関係を保ったまま、AIからの提案を受けられるようになります。

もちろん、200Kトークン超で$6/$22.50という価格設定は決して安くありません。しかし、分割作業に費やしていた時間コストや、文脈を失うことで生じる品質リスクを考慮すれば、多くの企業にとって合理的な投資と言えるでしょう。

この技術がもし皆さんの職場や個人プロジェクトに導入されたら、どんな変化が起こるのか。コードレビューの質は向上するのか、設計判断のスピードは上がるのか。そして何より、開発者の創造性がより高い領域に向かうのか。ぜひ想像しながら、この技術の可能性について考えてみてください。