Microsoftは2026年4月14日、テキスト・トゥ・イメージモデル「MAI-Image-2」の派生版「MAI-Image-2-Efficient」を発表した。

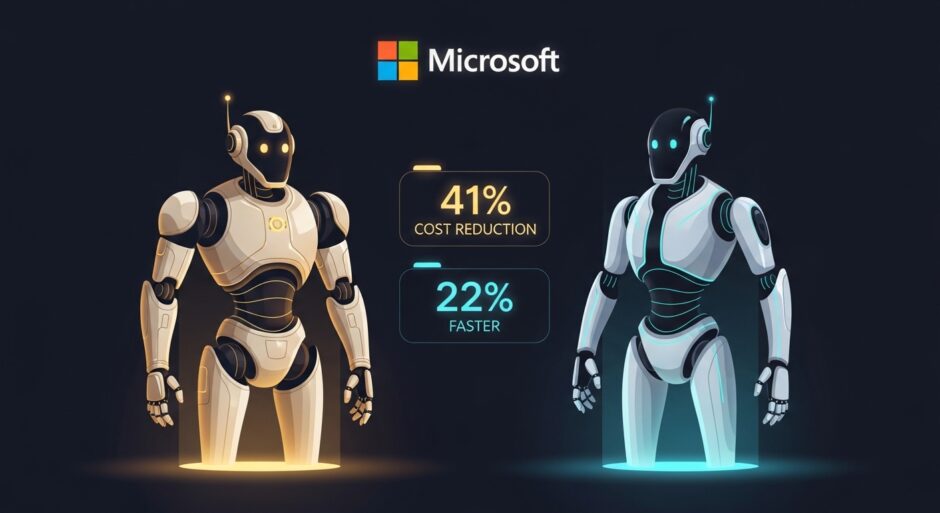

新モデルはMAI-Image-2比で22%高速、4倍効率的であり、画像出力トークンの価格は100万件あたり19.50ドルと、MAI-Image-2の33ドルより41%低い。テキスト入力トークンは両モデルとも100万件あたり5ドルである。GoogleのGemini 3.1 Flash(高度な推論)、Gemini 3.1 Flash Image、Gemini 3 Pro Imageとの比較においても40%高速だ。開発者はMicrosoft FoundryおよびMAI Playgroundで即日利用可能で、今後CopilotおよびBingへの展開も予定されている。なお、MAI-Image-2は2026年3月にMicrosoft Copilot、Bing Image Creator、MAI Playgroundで導入され、Arena.aiのランキングでトップ3に入っている。

From:  Microsoft Now Has Two Image AI Models—Here’s How They’re Different

Microsoft Now Has Two Image AI Models—Here’s How They’re Different

【編集部解説】

今回の発表で注目すべきは、モデルの性能そのものだけでなく、そのリリースの「速さ」にあります。MAI-Image-2がMAI Playgroundに初登場したのは2026年3月19日、Microsoft Foundryへの展開が始まったのが4月2日のこと。そこからわずか2週間足らずで、最適化された派生モデルを市場に送り出したことになります。これは従来の大企業型研究開発サイクルとはまったく異なるスピード感であり、VentureBeatはこの開発体制を「論文を出す研究機関ではなく、製品を反復出荷するスタートアップのように動いている」と評しています。

「4倍の効率性」という数字についても、補足が必要です。Microsoftの公式ブログによれば、この数値はNVIDIA H100上で1024×1024の解像度において、レイテンシとGPU使用量を基準に正規化した場合のスループットを比較したものです。つまり「同じ時間・同じGPUリソースでどれだけ多くの画像を生成できるか」という、開発者にとって実務直結の指標での優位性を示しています。「速い」というより「コンピュート資源の無駄がない」という表現が正確で、クラウドコストに敏感なエンジニアリングチームには刺さる訴求です。

また、両モデルの違いは速度だけではありません。Microsoftの公式ページには、MAI-Image-2-Efficientはシャープで輪郭の明確な描写が得意であり、イラストやアニメーション調の画像に向く一方、MAI-Image-2はよりなめらかで繊細なコントラストを持ち、深みのあるフォトリアル表現を得意とするとあります。元の記事ではこの視覚的な差異が触れられておらず、実際に使い分けを検討する開発者にとって重要な情報と言えるでしょう。

このモデルの登場によって何が変わるか。最もわかりやすい変化は「大量生成のハードルが下がる」ことです。ECサイトが商品ごとに何千枚もの画像を生成する、マーケティングチームが複数の広告クリエイティブをリアルタイムで試作する——これまでコスト面で現実的でなかったユースケースが、41%のコスト削減によって一気に射程に入ります。

一方で、慎重に見ておくべき側面もあります。Microsoft Foundryを経由した提供という形態上、実質的にAzureインフラへの依存度が高まることは否定できません。特定クラウドベンダーへのロックインは、スタートアップや中小規模の開発チームにとって長期的なリスクになりえます。また、MicrosoftはMAI-Image-2-Efficientの学習データや著作権ポリシーについて詳細を公開しておらず、生成された画像の商用利用に際しては、今後の規約変更にも目配りが必要です。画像生成AIをめぐる著作権訴訟は世界各地で続いており、この分野の規制環境はまだ流動的です。

より大きな文脈で捉えると、このリリースはMicrosoftがOpenAIとの関係から独立した「自前のAIスタック」を本格的に構築しつつあることの証左です。MAI-Transcribe-1(音声認識)、MAI-Voice-1(音声生成)に続くMAI-Image-2-Efficientの登場で、テキスト・音声・画像という主要なモダリティが自社モデルでカバーされました。2025年11月に発足したMAI Superintelligenceチームが、約5ヶ月でここまでの布陣を整えたことは、業界全体に対して強いメッセージを発しています。

Microsoft Build 2026での追加発表が予告されており、今後さらなるモデル展開が続く見通しです。AIモデルの「旗艦か、量産か」という二択アーキテクチャは、今後業界標準になる可能性があります。この流れがどこへ向かうのか、引き続き注視していきたいと思います。

【用語解説】

テキスト・トゥ・イメージモデル

テキストで記述した指示(プロンプト)をもとに、AIが自動的に画像を生成する技術・モデルの総称だ。「空に浮かぶ城の写真風イラスト」のような文章を入力するだけで、対応する画像が出力される。

トークン

AIモデルが言語や画像を処理する際の最小単位だ。テキストでは単語や文字のかたまり、画像生成では画像データの処理単位として使われる。MAI-Image-2-Efficientの価格表示にある「100万トークンあたり〇〇ドル」は、このトークン数を基準にしたAPIの課金単位である。

スループット

単位時間あたりに処理できるデータ量や作業量のことだ。画像生成の文脈では「1秒間・1GPUあたりに生成できる画像の枚数」を指す。MAI-Image-2-Efficientの「4倍の効率性」は、同一ハードウェアで4倍のスループットを達成することを意味する。

レイテンシ

処理要求を送信してから結果が返ってくるまでの遅延時間のことだ。リアルタイムな対話や表示が求められるアプリケーションでは、このレイテンシが低いほどユーザー体験が向上する。MAI-Image-2-Efficientの性能比較は「p50レイテンシ(全体の50%の処理が完了するまでの時間)」を基準に測定されている。

ハイパースケーラー

超大規模なクラウドインフラを保有・運営する巨大IT企業のことで、一般的にMicrosoft(Azure)、Google(Google Cloud)、Amazon(AWS)などを指す。AI分野では、こうした企業が自社クラウド上で大規模なAIモデルを開発・提供している。

MAI Superintelligenceチーム

2025年11月にMicrosoftが新設した社内AI研究開発組織だ。Microsoft AIのCEO、ムスタファ・スレイマンが率いており、MAI-Image-2をはじめとする自社製基盤モデルの開発を担っている。同チームは発足から約5ヶ月で複数の基盤モデルをリリースするという、従来の大企業研究機関とは異なるスピードで開発を進めている。

モダリティ

AIが扱う情報の種類・形式のことだ。テキスト、画像、音声、動画などがそれぞれ1つのモダリティに当たる。複数のモダリティを処理・生成できるAIシステムを「マルチモーダルAI」と呼ぶ。今回のMAIモデル群は、画像(MAI-Image-2)・音声認識(MAI-Transcribe-1)・音声生成(MAI-Voice-1)と、主要な3モダリティをカバーする。

【参考リンク】

Microsoft AI 公式サイト(外部)

Microsoftの自社AI部門が運営する公式ポータル。MAIモデルの発表ブログや技術詳細、各モデルのモデルカードが公開されている。

Arena.ai テキスト・トゥ・イメージ リーダーボード(外部)

ユーザーの好みをもとにAI画像生成モデルをランキングするベンチマークサイトだ。MAI-Image-2はここで3位にランクインしている。

NVIDIA H100(外部)

MAI-Image-2-Efficientのスループット計測に使用されたGPUの製品ページだ。大規模AI推論・学習向けの現世代最高性能クラスのアクセラレーターである。

【参考記事】

Introducing MAI-Image-2-Efficient: Faster, More Efficient Image Generation(外部)

Microsoft公式ブログ(2026年4月14日)。スループット計測条件(NVIDIA H100、1024×1024、p50レイテンシ基準)や対競合比較の詳細など、技術仕様の一次情報源だ。

Microsoft launches MAI-Image-2-Efficient, a cheaper and faster AI image model(外部)

VentureBeat(2026年4月14日)。価格・GPU効率の数値を裏付けつつ、MAI Superintelligenceチームの開発スタイルとOpenAI自立戦略を詳細に分析している。

Microsoft releases new AI models to expand further beyond OpenAI(外部)

GeekWire(2026年4月2日)。MAIモデル群のFoundry展開を報じ、OpenAIへの依存脱却という戦略的背景を整理した記事だ。

Microsoft Debuts MAI-Transcribe-1 Speech-to-Text Model That Tops Whisper, GPT, Gemini Flash(外部)

The Letter Two(2026年4月2日)。MAIファミリー全体の価格情報と製品ポートフォリオの全体像を把握するために参照した記事だ。

Microsoft In-House AI Models: MAI Strategy vs OpenAI (2026)(外部)

Tech Insider(2026年4月)。MAI Superintelligenceチームの発足経緯やMicrosoftの財務・戦略面の大局観を補う目的で参照した記事だ。

【編集部後記】

「旗艦モデルか、量産モデルか」という使い分けが、AIモデルの新しいあたりまえになりつつあります。みなさんは、どんな場面でこの2つを試してみたいと思いますか? MAI Playgroundで実際に触れてみると、また違った気づきがあるかもしれません。ぜひ、体験したことをわたしたちにも教えてください。